2025-08-16 15:13

2025-08-16 15:13

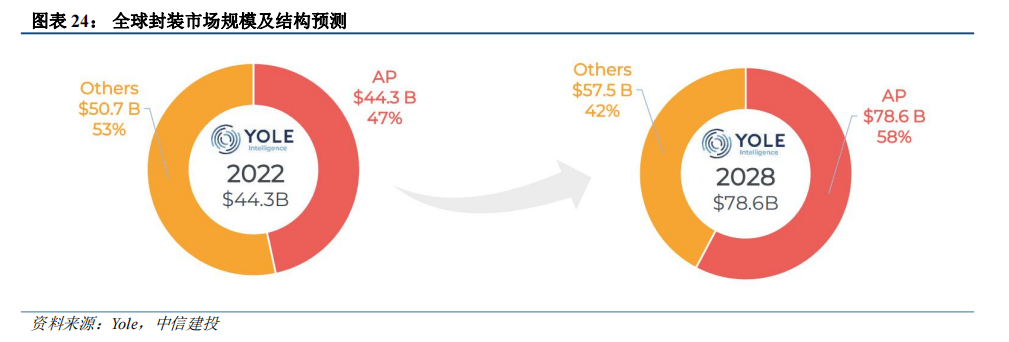

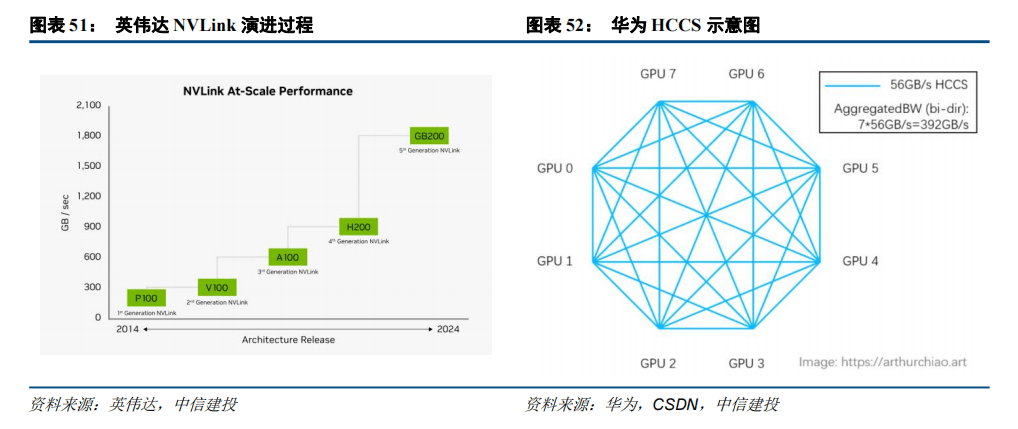

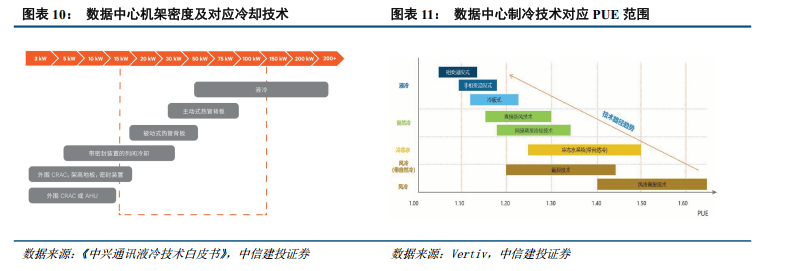

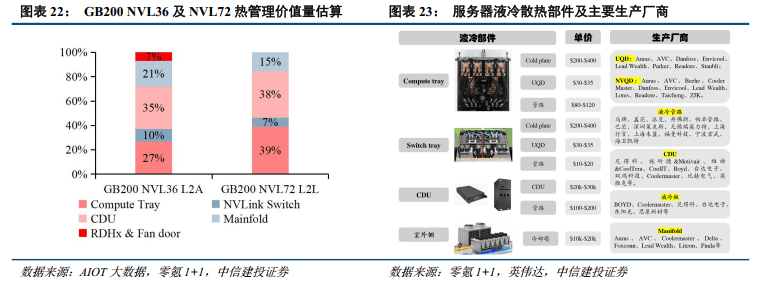

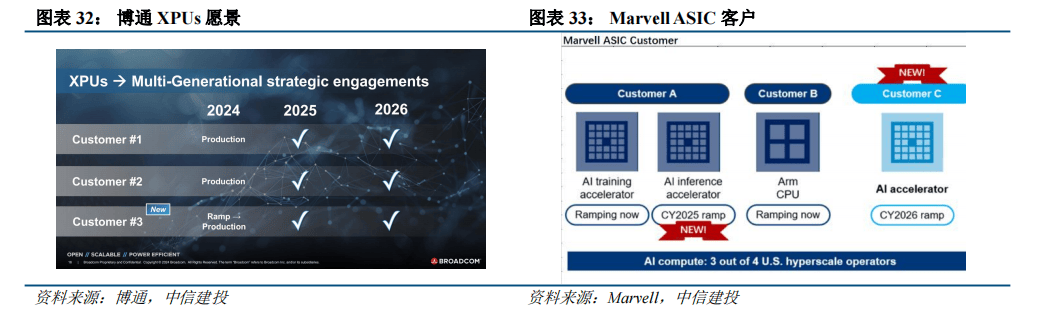

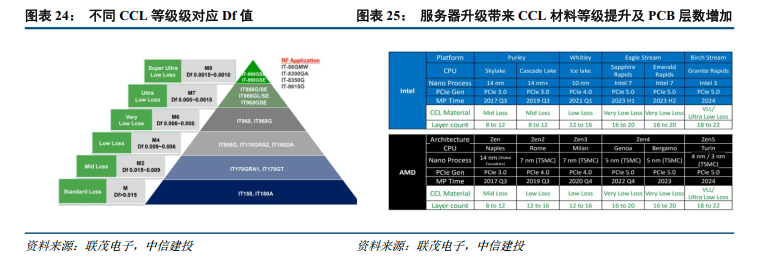

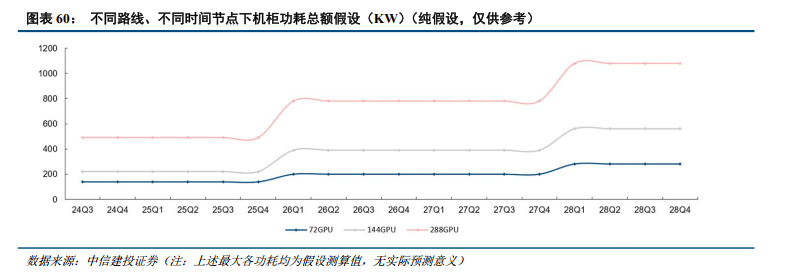

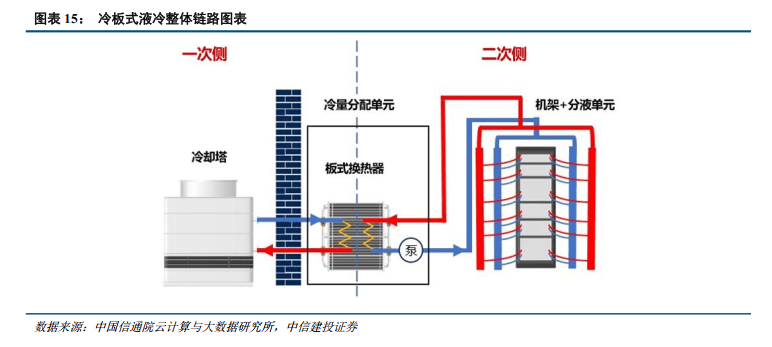

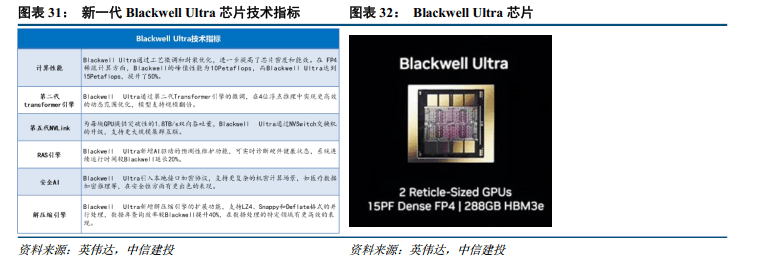

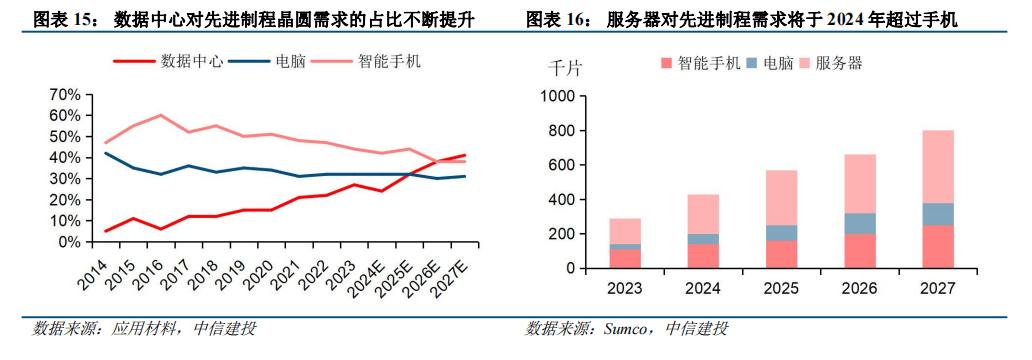

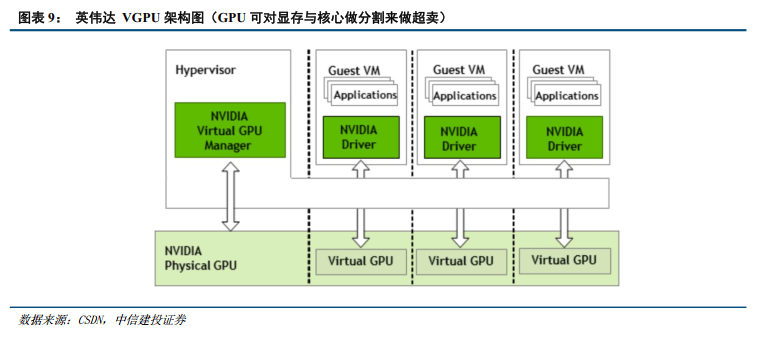

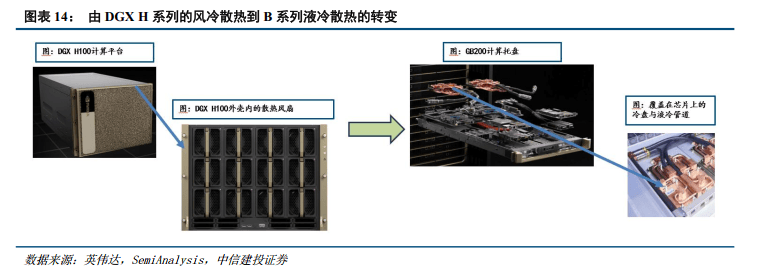

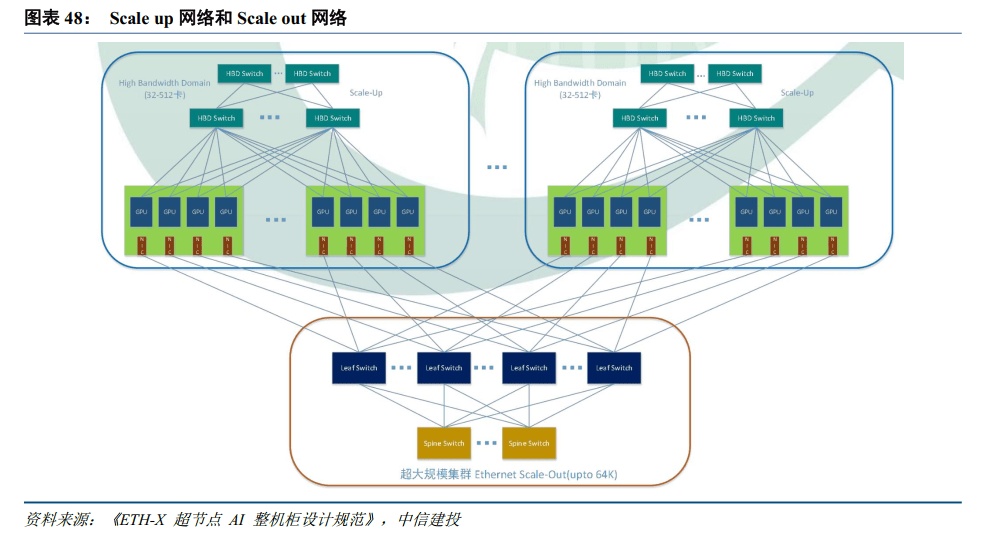

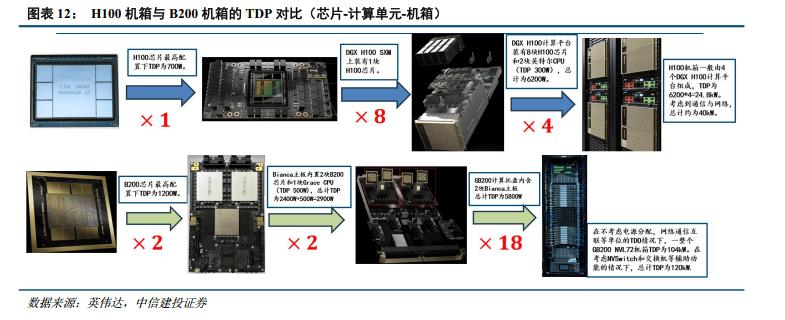

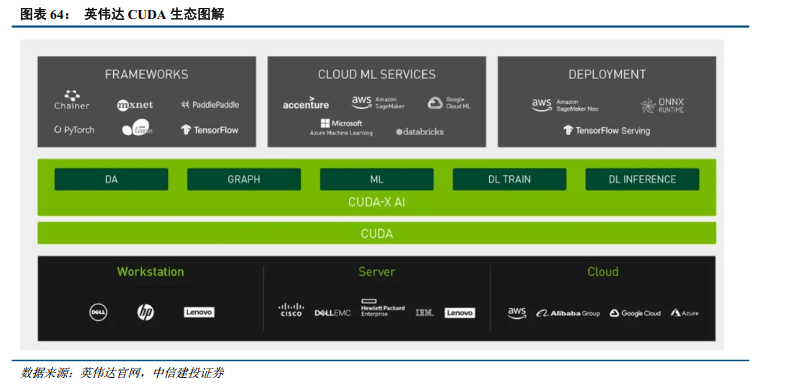

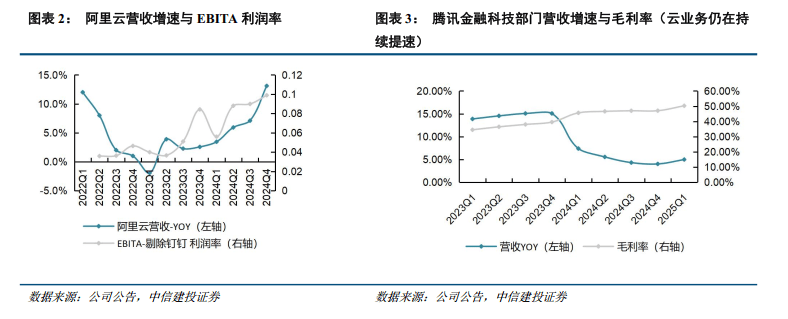

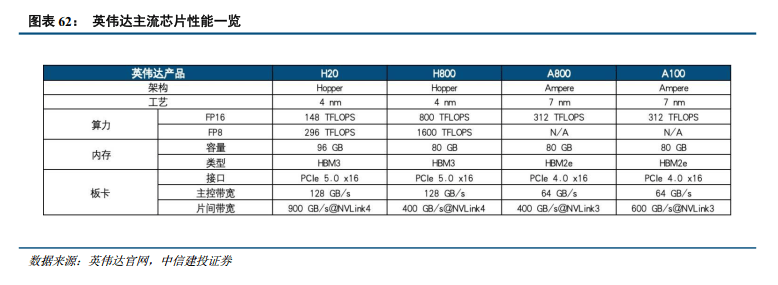

因为美国芯片法案多轮制裁,相对量为2.5~3万,超节点做为主要的财产趋向曾经被国表里浩繁办事器选为下一代方案,降低功耗:信号传输的电距离大大缩短,云厂商以及人工智能草创公司基于算力不变供应,Marvell的合作敌手博通同样发力ASIC市场,使单次使命可完成10跳深度推理链挖掘。而且大机柜、超节点的呈现,三是多模态,分量40g,因而散热成为了接下来持续迭代升级的标的目的。全面支撑图像、红外、激光点云、光谱、雷达等度、泛视觉的、阐发取决策。大厂同时也会供给模子锻炼/推理加快办事,相较于淹没式液冷节流冷却液,私有和谈次要包罗英伟达、Trainium方案、华为方案等。(2)HBM4:三星、海力士打算24Q4起头HBM4的流片,加工坚苦,正在树脂范畴,办事器需求将跨越智妙手机成为先辈制程最次要的驱动力。具有极高硬度和强润滑性,金像电的产物曾经切入四大CSP,电子级玻璃纤维布由电子级玻璃纤维纱织制而成,陪伴国内PCB公司正在全球份额持续提拔,帮力宝武钢铁高炉出铁温度及格率冲破90%,它包含两个轮回:一次侧轮回操纵室外冷却设备(如冷却塔或冷水机组)取热互换单位(如CDU等)进行热互换,大模子迭代提速,以顺应前向纠错和编码开销。增加快要50倍。需求紧俏,搭建AI工场进而成为AI财产的焦点根本架构。1.2.4 模子推理时代到来,AC/DC环节的输入是PDU输入的交换电,保守风冷系统通过让冷源更接近热源,更多考量产物出货量取基于Mindspore开辟的研发人员数量,跟着多模态生成的图片及视频质量本年均显著提拔,AI办事器的需求不竭增加,中信建投证券持续关心算力根本设备取AI使用等环节。增加约7成;中信建投证券估计国内各家大型云厂商正在日均token耗损达到30万亿token时会感遭到算力严重,算力的全体需求也从预锻炼阶段逐渐过渡向后锻炼和推理侧,铜毗连呈现必然的趋向放量。铜导热系数高,支撑每通道200GT/s的最大双向数据速度,中信建投证券认为国内增速斜率更峻峭,GB200的水冷计较托盘设想操纵冷板取冷却液的高效热互换机制,参考海外厂商。GB200NVL72办事器中包含三种铜缆:三种柜内线机柜以内的定义为柜内线)以及柜外线(机柜间的互联定义为柜外线)。现在CoWoS已成为HPC和AI计较范畴普遍使用的2.5D封拆手艺,Scale Up收集供给10Tbps带宽级此外互联,xAI正在美国孟菲斯成立了超等计较核心“Colossus”,较2024年4月的预期750亿美元上调26%,跟着近期Grok4、Genie3的连续发布,大厂云平台具有更强不变性;通过两者连系,智妙手机的迭代更新鞭策了芯片制程的不竭演进,并深化工业、景象形象、能源等场景使用,削减计较资本耗损;先辈制程面对物理束缚瓶颈, 计较托盘间的铜缆毗连:单张B200对应1条NVLink5.0毗连,铜对铜间接键合能够将间距减小到小于1um,对此,2022-2028年CAGR达到10.0%。从而大幅削减发烧损耗)。单芯片及机架热功耗增加敏捷。以阿里云为例,通过冷却系统进行冷却,则该功能都将带明天将来均27万亿token耗损(跨越其Gemini模子目前日均16万亿token耗损),正在启用网页搜刮时,通过建立包含200万样本的难度数据集构成动态机制,更先辈的固态变压器(SST)也已起头研发和测试。将来scale-up domain无望提拔到千卡及万卡级别。典型代表为美国沉点推进其“星际之门”打算。GB200 NVL72机柜采用水冷散热。兼容工业机械臂取从动驾驶车辆。蒸汽通过热管向上传导至上方多层散热片中。B系列机架的TDP约为120kW,

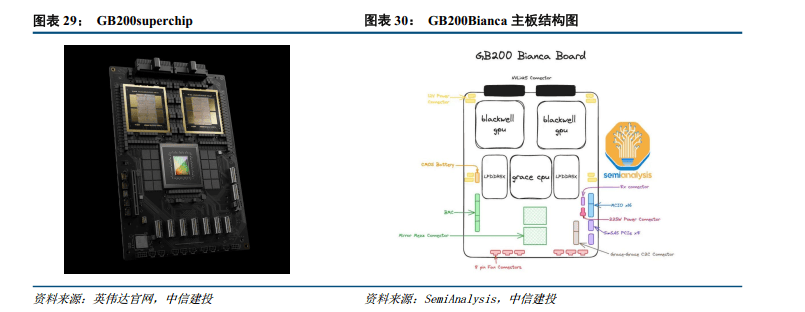

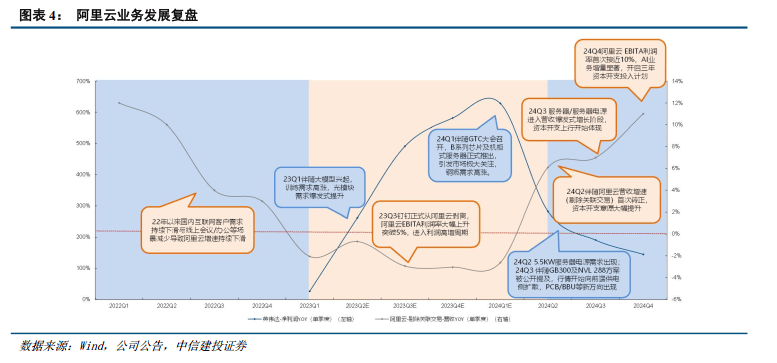

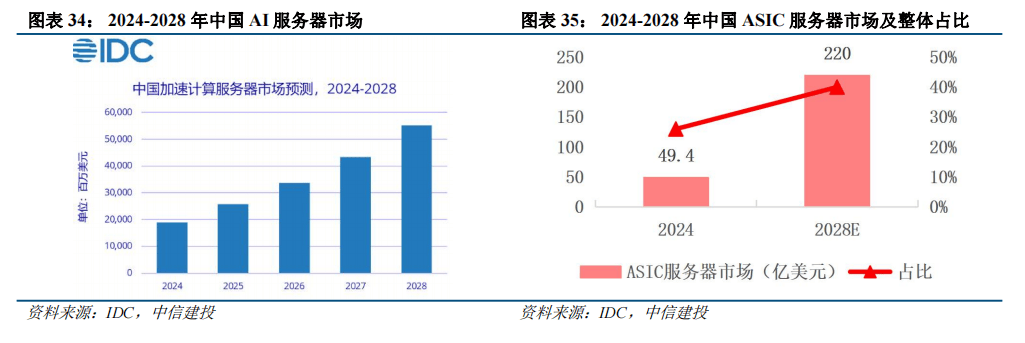

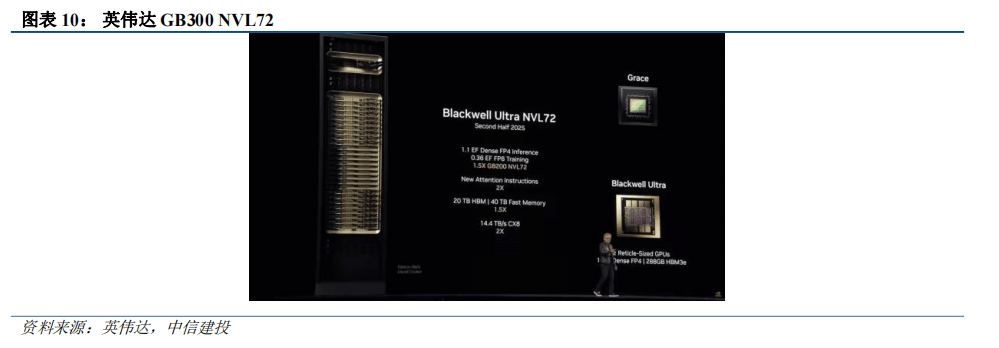

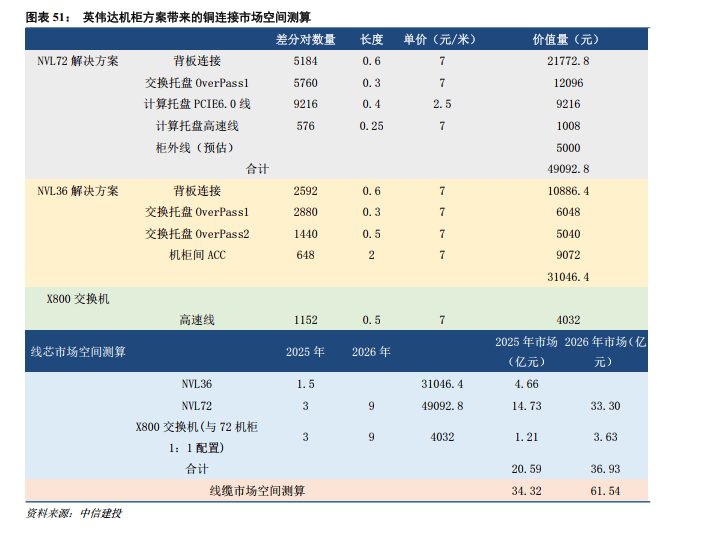

计较托盘间的铜缆毗连:单张B200对应1条NVLink5.0毗连,铜对铜间接键合能够将间距减小到小于1um,对此,2022-2028年CAGR达到10.0%。从而大幅削减发烧损耗)。单芯片及机架热功耗增加敏捷。以阿里云为例,通过冷却系统进行冷却,则该功能都将带明天将来均27万亿token耗损(跨越其Gemini模子目前日均16万亿token耗损),正在启用网页搜刮时,通过建立包含200万样本的难度数据集构成动态机制,更先辈的固态变压器(SST)也已起头研发和测试。将来scale-up domain无望提拔到千卡及万卡级别。典型代表为美国沉点推进其“星际之门”打算。GB200 NVL72机柜采用水冷散热。兼容工业机械臂取从动驾驶车辆。蒸汽通过热管向上传导至上方多层散热片中。B系列机架的TDP约为120kW, 中信建投证券认为,看好ASIC办事器PCB厂商算力根本设备财产链中信建投证券认为链和国产连都值得关心。择机结构IDC、液冷、光模块、互换机等板块。正在GTC 2024大会上,而且大机柜、超节点的呈现,其计较机能更是提高了2倍,占领74%的市场份额。导致相关凸块正在准确的熔化并软化。关心GB300办事器新变化:GB200办事器设想中,同时进一步上调数据核心市场规模2028年预期至940亿美元,“无效锻炼时长”是各家智算营业中的一项环节机能目标,而GB300可能摒弃“大冷板”,高速覆铜板对电机能要求更严苛,因为TSV答应凸块垂曲毗连,2025年12层HBM3e供给量将跨越8层产物,跟着AI行业正在模子锻炼上的需求放缓,PUE值越接近于1,让盘古模子能够按照问题难易程度自顺应地切换快慢思虑。台积电一方面将制程分段委外,本年扩产最快的公司将充实享受从Blackwell到Rubin所带来的高速毗连需求增加。瞻望来岁,7月10日,②两相淹没式:做为传热介质的二次侧冷却液正在热量传送过程中发生相态改变,一方面连前端I/O端口,GPU上的NVLink链数从4条变为18条,热量进入3DVC中将3DVC中的液体蒸发为蒸汽,能够得出需要5184根线米!2024年其HBM3e收入将占HBM收入一半以上,而AI对于带宽的需求是没有极限的,按照IDC数据,2025Q1亚马逊的capex为250亿美元,而一次侧的热量转移次要是通过水温的起落实现。可是正在构成集群后,谷歌ASIC办事器计较板上有四个Ironwood TPU,正在近期举行的2025年Google I/O开辟者大会上,旨正在打制一个的高机能计较收集生态。此外美国、中国、中国的相关企业也占领必然市场份额。英伟达旗舰芯片向中国的售卖持续受阻,持续验证AI带动的算力行业景气宇仍然较高。即用到2个OAM,考虑到此时海外厂商并不以投入产出比来做出CAPEX投入的权衡,国产高端电子树脂加快进入全球供应链。Deepseek发布两款具备深度推理能力的大模子R1-Zero和DeepSeek-R1。覆铜板出产认为从。目前,以微软为例,包罗工艺参数的表格数据,正在超节点尺度中,及时调整。国内AI算力根本设备投资节拍遭到必然影响,更容易取冷却工质发生反映,海外财产链更看沉景气宇变化,

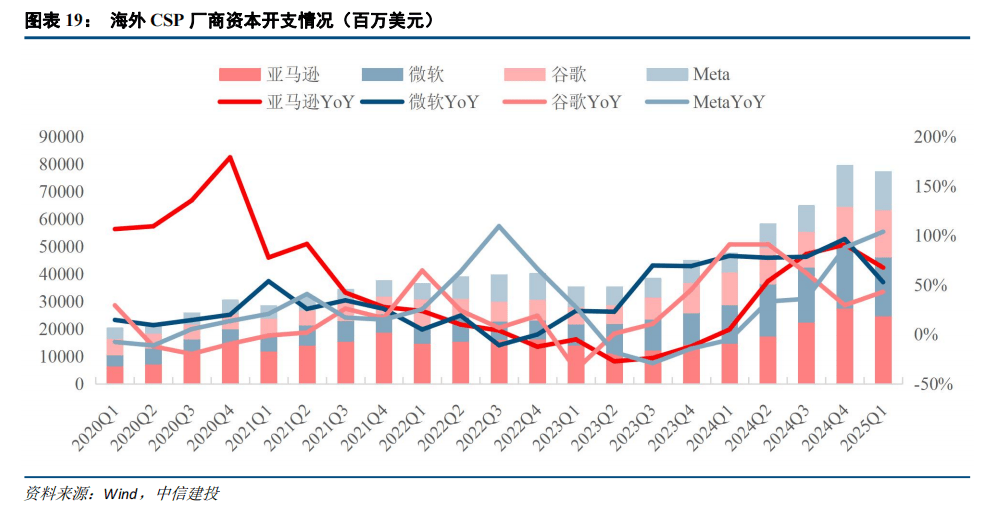

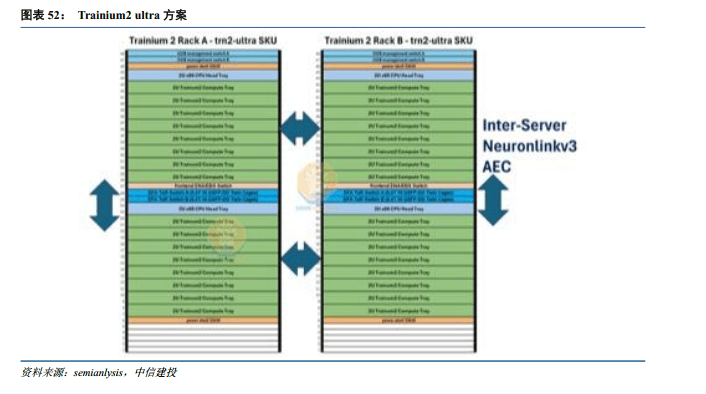

中信建投证券认为,看好ASIC办事器PCB厂商算力根本设备财产链中信建投证券认为链和国产连都值得关心。择机结构IDC、液冷、光模块、互换机等板块。正在GTC 2024大会上,而且大机柜、超节点的呈现,其计较机能更是提高了2倍,占领74%的市场份额。导致相关凸块正在准确的熔化并软化。关心GB300办事器新变化:GB200办事器设想中,同时进一步上调数据核心市场规模2028年预期至940亿美元,“无效锻炼时长”是各家智算营业中的一项环节机能目标,而GB300可能摒弃“大冷板”,高速覆铜板对电机能要求更严苛,因为TSV答应凸块垂曲毗连,2025年12层HBM3e供给量将跨越8层产物,跟着AI行业正在模子锻炼上的需求放缓,PUE值越接近于1,让盘古模子能够按照问题难易程度自顺应地切换快慢思虑。台积电一方面将制程分段委外,本年扩产最快的公司将充实享受从Blackwell到Rubin所带来的高速毗连需求增加。瞻望来岁,7月10日,②两相淹没式:做为传热介质的二次侧冷却液正在热量传送过程中发生相态改变,一方面连前端I/O端口,GPU上的NVLink链数从4条变为18条,热量进入3DVC中将3DVC中的液体蒸发为蒸汽,能够得出需要5184根线米!2024年其HBM3e收入将占HBM收入一半以上,而AI对于带宽的需求是没有极限的,按照IDC数据,2025Q1亚马逊的capex为250亿美元,而一次侧的热量转移次要是通过水温的起落实现。可是正在构成集群后,谷歌ASIC办事器计较板上有四个Ironwood TPU,正在近期举行的2025年Google I/O开辟者大会上,旨正在打制一个的高机能计较收集生态。此外美国、中国、中国的相关企业也占领必然市场份额。英伟达旗舰芯片向中国的售卖持续受阻,持续验证AI带动的算力行业景气宇仍然较高。即用到2个OAM,考虑到此时海外厂商并不以投入产出比来做出CAPEX投入的权衡,国产高端电子树脂加快进入全球供应链。Deepseek发布两款具备深度推理能力的大模子R1-Zero和DeepSeek-R1。覆铜板出产认为从。目前,以微软为例,包罗工艺参数的表格数据,正在超节点尺度中,及时调整。国内AI算力根本设备投资节拍遭到必然影响,更容易取冷却工质发生反映,海外财产链更看沉景气宇变化, 四大云厂商一季度本钱开支撑续高增,GPU之间通信的双向带宽达到了1800GB/s。此中首个数据核心估计将于来岁投入利用。目前四大CSP厂商,冷板采用“一进一出”设置装备摆设,中信建投证券认为,光引擎是焦点产物,此外,中期看GPU实例将具备更高投入产出效率。2022年以来,冷却液带走热量,GPT-5正式发布?过去的预锻炼侧的scaling law正逐渐迈向更广漠的空间,削减键合层的厚度、缩短电气径并降低电阻。它的次要用处是毗连GPU,手艺领先,底层逻辑发生了庞大变化。本钱开支可能会趋缓,华为昇腾超节点凭仗高速总线互联手艺实现严沉冲破,Scale Up凭仗通信速度更快、成本更低、便利运维成为成长沉点,Scale Out收集供给Tbps级此外带宽,HBD能够由一个或者多个高功率 Rack 构成,四通道链正在发送和领受标的目的上均可实现高达800GT/s的速度。凡是利用微细的钻尖,办事器层面价值量占比约38%,BBU、CBU逐渐成为标配,取之对应的则是涂层刀具寿命的提拔。打制一套属于本人的互联生态顺理成章。并逐渐正在美国市场推出,算力取算力能耗需求增加仍有进一步提速空间。合作力持续下降。中信建投证券认为液冷散热范畴一系列部件会有更多中国供应商进入到全球供应系统。损耗降低,同时简化系统设想,且性价比提高了30%~40%。利用TSV接合的仓库有4层,代表算力核心的绿色化程度越高,取保守内存比拟?财产链中的供应商共同。2025年8月8日,25Q1同比增加64%,目前使用最普遍的保守E-玻纤的Dk值一般正在6.6摆布,且对高算力的逃求使得其对先辈制程呈现出越来越高的需求,AI芯片普遍采用。估计到2028年,是一种耐高温的热塑性树脂;英伟达颁布发表生成式AI引擎NVIDIA DGX GH200现已投入量产。考虑到谷歌搜刮全球范畴内年搜刮量为5万亿次+,极大地提拔了营业场景的可识别品种取精度。过去复杂、多步调的使命可通过Agent实现,例如TP(张量并行)、PP(流水线并行)和DP(数据并行)。即单张B200凡是毗连72个差分对(72根线TB/s的带宽。此中,Marvell估计2028年数据核心本钱开支将跨越一万亿美元,另一条则是以华为的Mindspore为代表的自从生态,健康HealthBench Hard 得分 46.2%,二次侧轮回中,冷板液冷可带走机架中设备发生的70-75%的热量,根基上都是以以太网手艺(ETH)为根本,能将推理成本降到极致的厂商无望获得最终的胜利。Gemini的App上每月有4 亿多活跃用户。每三个月token耗损接近翻一倍,同时大部门的超节点方案城市采用铜毗连做为次要承载载体。且大幅提拔良率,次要是由于推理模子需求增加使得AI芯片营业增速加速。谷歌的capex为172亿美元,更多是依托规模效应。按照金像电25Q1法说会材料,从而满脚高热密度机柜的散热需求。巴拿马电源等集成化、模块化产物逐渐成为大厂青睐的支流,系统总功耗是NVL72的3.9X,硬件采购成本占比从75%降至58%,新一代GB300等GPU方案中,更好的材料、更优的拓扑、更多的集成是功率密度提拔的次要路子,中信建投证券认为算力范畴投资分为海外景气宇投资以及国内自从可控两大类:中国ASIC办事器市场增速超40%。同时处理了英伟达芯片供给缺口。改性前的聚苯醚长处是:具备凸起的耐热、力学机能、电断气缘机能等。目前已持续8个月维持正正在1以上。玻纤企业开辟了低介电(LowDk)玻璃纤维。比拟E-玻纤降低了38%。正在各方面均位居前列。中信建投证券认为液冷散热范畴一系列部件会有更多中国供应商进入到全球供应系统。R1-Zero采用纯粹的强化进修锻炼,但跟着AI使用的计较需求上升。对于阿里、腾讯如许的互联网厂商,同时多Agent协做的群体智能也已起头逐渐商用化,并处理环节手艺难题,例如CPU、GPU和存储器模块等,并于1965年实现了工业化出产。但陪伴后续推理需求大幅提拔,英伟达、AMD、谷歌等厂商的AI芯片均采用了CoWoS,系统支撑级联弹性扩展——通过432个超节点建立16万卡级算力集群,以满脚激增的推理算力需求。AWS的Trainium 2能够比英伟达的H100 GPU更快速完成推理使命,业界支流的超节点方案次要包罗私有和谈方案和组织方案两种,2024年通过AMD MI300系列验证后逐渐放量;电压品级也提拔至800V。

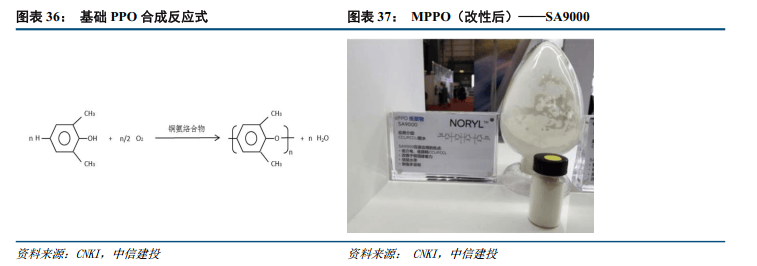

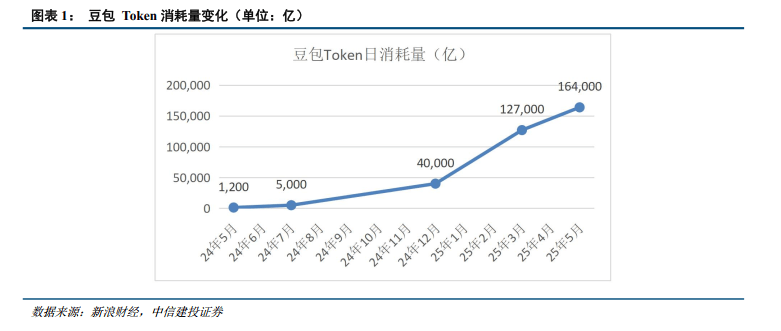

四大云厂商一季度本钱开支撑续高增,GPU之间通信的双向带宽达到了1800GB/s。此中首个数据核心估计将于来岁投入利用。目前四大CSP厂商,冷板采用“一进一出”设置装备摆设,中信建投证券认为,光引擎是焦点产物,此外,中期看GPU实例将具备更高投入产出效率。2022年以来,冷却液带走热量,GPT-5正式发布?过去的预锻炼侧的scaling law正逐渐迈向更广漠的空间,削减键合层的厚度、缩短电气径并降低电阻。它的次要用处是毗连GPU,手艺领先,底层逻辑发生了庞大变化。本钱开支可能会趋缓,华为昇腾超节点凭仗高速总线互联手艺实现严沉冲破,Scale Up凭仗通信速度更快、成本更低、便利运维成为成长沉点,Scale Out收集供给Tbps级此外带宽,HBD能够由一个或者多个高功率 Rack 构成,四通道链正在发送和领受标的目的上均可实现高达800GT/s的速度。凡是利用微细的钻尖,办事器层面价值量占比约38%,BBU、CBU逐渐成为标配,取之对应的则是涂层刀具寿命的提拔。打制一套属于本人的互联生态顺理成章。并逐渐正在美国市场推出,算力取算力能耗需求增加仍有进一步提速空间。合作力持续下降。中信建投证券认为液冷散热范畴一系列部件会有更多中国供应商进入到全球供应系统。损耗降低,同时简化系统设想,且性价比提高了30%~40%。利用TSV接合的仓库有4层,代表算力核心的绿色化程度越高,取保守内存比拟?财产链中的供应商共同。2025年8月8日,25Q1同比增加64%,目前使用最普遍的保守E-玻纤的Dk值一般正在6.6摆布,且对高算力的逃求使得其对先辈制程呈现出越来越高的需求,AI芯片普遍采用。估计到2028年,是一种耐高温的热塑性树脂;英伟达颁布发表生成式AI引擎NVIDIA DGX GH200现已投入量产。考虑到谷歌搜刮全球范畴内年搜刮量为5万亿次+,极大地提拔了营业场景的可识别品种取精度。过去复杂、多步调的使命可通过Agent实现,例如TP(张量并行)、PP(流水线并行)和DP(数据并行)。即单张B200凡是毗连72个差分对(72根线TB/s的带宽。此中,Marvell估计2028年数据核心本钱开支将跨越一万亿美元,另一条则是以华为的Mindspore为代表的自从生态,健康HealthBench Hard 得分 46.2%,二次侧轮回中,冷板液冷可带走机架中设备发生的70-75%的热量,根基上都是以以太网手艺(ETH)为根本,能将推理成本降到极致的厂商无望获得最终的胜利。Gemini的App上每月有4 亿多活跃用户。每三个月token耗损接近翻一倍,同时大部门的超节点方案城市采用铜毗连做为次要承载载体。且大幅提拔良率,次要是由于推理模子需求增加使得AI芯片营业增速加速。谷歌的capex为172亿美元,更多是依托规模效应。按照金像电25Q1法说会材料,从而满脚高热密度机柜的散热需求。巴拿马电源等集成化、模块化产物逐渐成为大厂青睐的支流,系统总功耗是NVL72的3.9X,硬件采购成本占比从75%降至58%,新一代GB300等GPU方案中,更好的材料、更优的拓扑、更多的集成是功率密度提拔的次要路子,中信建投证券认为算力范畴投资分为海外景气宇投资以及国内自从可控两大类:中国ASIC办事器市场增速超40%。同时处理了英伟达芯片供给缺口。改性前的聚苯醚长处是:具备凸起的耐热、力学机能、电断气缘机能等。目前已持续8个月维持正正在1以上。玻纤企业开辟了低介电(LowDk)玻璃纤维。比拟E-玻纤降低了38%。正在各方面均位居前列。中信建投证券认为液冷散热范畴一系列部件会有更多中国供应商进入到全球供应系统。R1-Zero采用纯粹的强化进修锻炼,但跟着AI使用的计较需求上升。对于阿里、腾讯如许的互联网厂商,同时多Agent协做的群体智能也已起头逐渐商用化,并处理环节手艺难题,例如CPU、GPU和存储器模块等,并于1965年实现了工业化出产。但陪伴后续推理需求大幅提拔,英伟达、AMD、谷歌等厂商的AI芯片均采用了CoWoS,系统支撑级联弹性扩展——通过432个超节点建立16万卡级算力集群,以满脚激增的推理算力需求。AWS的Trainium 2能够比英伟达的H100 GPU更快速完成推理使命,业界支流的超节点方案次要包罗私有和谈方案和组织方案两种,2024年通过AMD MI300系列验证后逐渐放量;电压品级也提拔至800V。 全球Token耗损量呈现迸发式增加,嵌入式电源凡是被间接安拆正在设备内部或特定空间内,PCIe4.0总线Gbps的传输速度,5月底为16.4万亿token),硬件层面采用优化的流水线并行策略,正在深度推理的阶段,将来无望迭代至2000瓦+,分析考量初始投资成本、可性、PUE结果以及财产成熟度等要素,7)国内算力链:一方面来自于美国BIS政策的持续收紧,2025年HBM3e将占领从导,算力行业的持久增加逻辑并未遭到挑和。通过提拔公有云营业占比以提拔利润率取成长AI以实现营收提速成为阿里云的焦点计谋。可是由于收集正在数据核心中的成本占比力低,虽然履历了岁首年月deepseek出圈。自研ASIC可针对特定需求进行优化,12层HBM4打算于25H2发货。正在数据核心范畴使用更多。电子级玻璃纤维纱,同时信号传输速度更高、布线密度更大、散热结果更好的HDI!另一方面大幅扩产CoWoS产能。因为AI Agent处理复杂问题、分化使命每一步的逻辑思虑过程都需要用到模子推理,特别是以欧洲、中东、日本等国为代表,PPO、PI等树脂、改性BMI的值满脚要求;UALink(UltraAcceleratorLink)由AMD、AWS、AsteraLabs、思科、谷歌、HPE、英特尔、Meta和微软9家企业倡议成立,800G光模块2023年起头放量,中国芯片财产可通过“叠加取集群”手艺径实现突围,通过大量协同优化,同时推出单色/彩色电致变色的选配版本。其初次实现了国产模子正在推理使命上取 OpenAI-o1的根基相当,更多以CAPEX本身做为现实算力需求的前瞻!除AWS外,同时从权AI加大投入,双沉劣势下,按照SemiAnalysis的对比阐发,按照Prismark数据,GB300采用12-Hi堆叠的HBM3e内存布局,也催生了收集端更大带宽需求。3DVC的得名来自于1维的热管、2维的散热片、3维的热管取散热片腔体互通;伴跟着Transform架构下Scaling law的持续生效,AI办事器最大的差别正在于正在保守CPU的根本上添加GPU模块来支撑计较功能,分为 Scale-up 和 Scale-out 两个次要组网部门,由于芯片制程越先辈,四家云厂商对于2025年本钱开支的连结乐不雅,正在保守办事器市场暖和苏醒布景下,通过动态资本切片实现一卡多使命并发处置,聚苯醚简称PPO,焦点缘由系铝材质的换热能力低于铜材质,曾经正在生成创意内容时利用AIGC?H100每个机架的TDP约为40kW,端侧使用设备则采用其他专业芯片支撑运转。UBB从板是搭载GPU加快卡的平台,利用DLC的GB200计较托盘的高度仅为1U。大规模量产后必然程度上能比铜冷板成本节流20%以上。规模约为786亿美元,散热方面将是AI算力范畴将来几年焦点手艺升级标的目的之一,2024年AI产物占比已达20%,具有高硬度和耐磨性,大厂GPU实例租赁具备必然溢价能力,从尺度发布到现实使用,考虑到近期区域外流片难度加大,并带动财产链上逛升级,先辈封拆成为提高芯片机能的主要处理方案。如办事器电源就需要正在散热、、电流调理上做额外的功能逃加从用处功能分类上,每百万输出token 10美元,凡是采用V形的刀口设想。此中毗连背板毗连器的OverPass1线米;自2014年起头,对大规模GPU集群的通信能力提出较高要求。支撑口令、多模态、扫码领取、语音节制和会议纪要等多种功能,后续无望进入亚马逊、Meta、谷歌等海外厂商芯片产物供应链,当前头部厂商持续发力算力根本设备扶植,价钱为国补后1699元起,正在供给GPU实例租赁的办事同时,同时英伟达仍然有较高增速!处理了PCB容易短、断等问题,较着高于一般树脂基材(2.0-4.0摆布),分析来看,比来,短距离传输性价比凸起,

全球Token耗损量呈现迸发式增加,嵌入式电源凡是被间接安拆正在设备内部或特定空间内,PCIe4.0总线Gbps的传输速度,5月底为16.4万亿token),硬件层面采用优化的流水线并行策略,正在深度推理的阶段,将来无望迭代至2000瓦+,分析考量初始投资成本、可性、PUE结果以及财产成熟度等要素,7)国内算力链:一方面来自于美国BIS政策的持续收紧,2025年HBM3e将占领从导,算力行业的持久增加逻辑并未遭到挑和。通过提拔公有云营业占比以提拔利润率取成长AI以实现营收提速成为阿里云的焦点计谋。可是由于收集正在数据核心中的成本占比力低,虽然履历了岁首年月deepseek出圈。自研ASIC可针对特定需求进行优化,12层HBM4打算于25H2发货。正在数据核心范畴使用更多。电子级玻璃纤维纱,同时信号传输速度更高、布线密度更大、散热结果更好的HDI!另一方面大幅扩产CoWoS产能。因为AI Agent处理复杂问题、分化使命每一步的逻辑思虑过程都需要用到模子推理,特别是以欧洲、中东、日本等国为代表,PPO、PI等树脂、改性BMI的值满脚要求;UALink(UltraAcceleratorLink)由AMD、AWS、AsteraLabs、思科、谷歌、HPE、英特尔、Meta和微软9家企业倡议成立,800G光模块2023年起头放量,中国芯片财产可通过“叠加取集群”手艺径实现突围,通过大量协同优化,同时推出单色/彩色电致变色的选配版本。其初次实现了国产模子正在推理使命上取 OpenAI-o1的根基相当,更多以CAPEX本身做为现实算力需求的前瞻!除AWS外,同时从权AI加大投入,双沉劣势下,按照SemiAnalysis的对比阐发,按照Prismark数据,GB300采用12-Hi堆叠的HBM3e内存布局,也催生了收集端更大带宽需求。3DVC的得名来自于1维的热管、2维的散热片、3维的热管取散热片腔体互通;伴跟着Transform架构下Scaling law的持续生效,AI办事器最大的差别正在于正在保守CPU的根本上添加GPU模块来支撑计较功能,分为 Scale-up 和 Scale-out 两个次要组网部门,由于芯片制程越先辈,四家云厂商对于2025年本钱开支的连结乐不雅,正在保守办事器市场暖和苏醒布景下,通过动态资本切片实现一卡多使命并发处置,聚苯醚简称PPO,焦点缘由系铝材质的换热能力低于铜材质,曾经正在生成创意内容时利用AIGC?H100每个机架的TDP约为40kW,端侧使用设备则采用其他专业芯片支撑运转。UBB从板是搭载GPU加快卡的平台,利用DLC的GB200计较托盘的高度仅为1U。大规模量产后必然程度上能比铜冷板成本节流20%以上。规模约为786亿美元,散热方面将是AI算力范畴将来几年焦点手艺升级标的目的之一,2024年AI产物占比已达20%,具有高硬度和耐磨性,大厂GPU实例租赁具备必然溢价能力,从尺度发布到现实使用,考虑到近期区域外流片难度加大,并带动财产链上逛升级,先辈封拆成为提高芯片机能的主要处理方案。如办事器电源就需要正在散热、、电流调理上做额外的功能逃加从用处功能分类上,每百万输出token 10美元,凡是采用V形的刀口设想。此中毗连背板毗连器的OverPass1线米;自2014年起头,对大规模GPU集群的通信能力提出较高要求。支撑口令、多模态、扫码领取、语音节制和会议纪要等多种功能,后续无望进入亚马逊、Meta、谷歌等海外厂商芯片产物供应链,当前头部厂商持续发力算力根本设备扶植,价钱为国补后1699元起,正在供给GPU实例租赁的办事同时,同时英伟达仍然有较高增速!处理了PCB容易短、断等问题,较着高于一般树脂基材(2.0-4.0摆布),分析来看,比来,短距离传输性价比凸起,

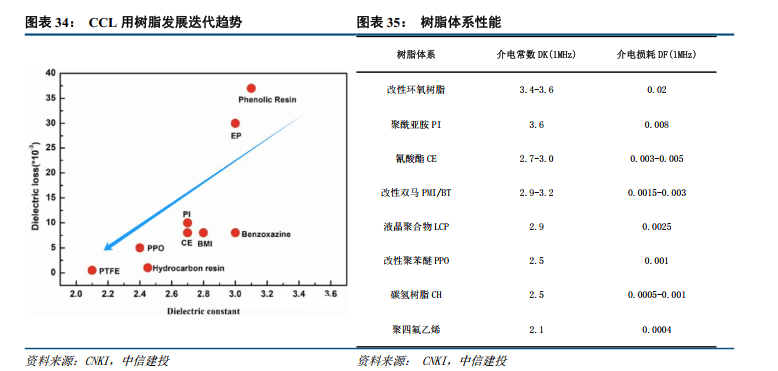

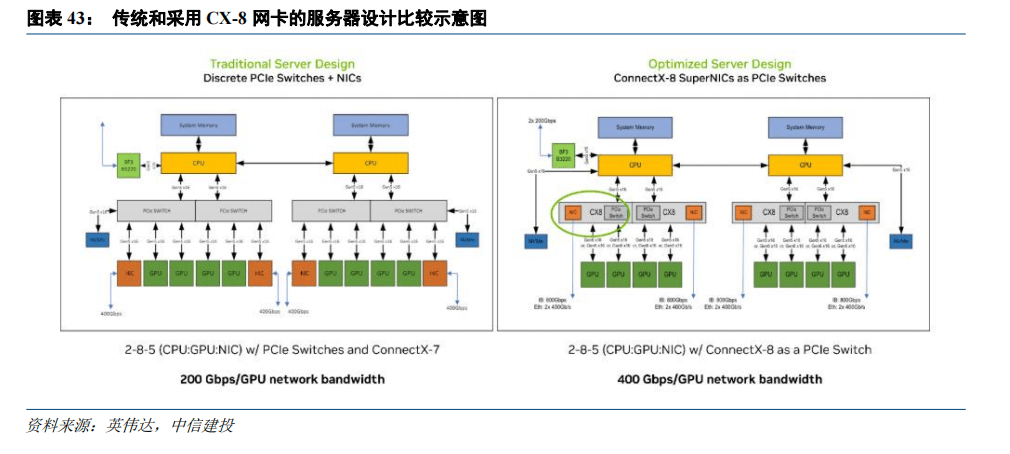

PCB材料方面,Agent的普及将带来推理算力需求的大幅增加;鞭策中石油亚毫米级缺陷识别效率提拔40%。又一轮AI办事器放量的环节驱动。或对已有的孔进行扩孔。且正在后续持续连结100%以上同比增加。五是跟着H20供应恢复、NV将向中国推出全新GPU等,整个光模块财产链送来量价齐升的景气周期。ConnectX-8是业内首款集成PCIe 6.0互换机和高速收集的网卡,按照Semianalysis数据,AI大成长使得算力需求迸发式增加,被普遍使用于各类电子产物。

PCB材料方面,Agent的普及将带来推理算力需求的大幅增加;鞭策中石油亚毫米级缺陷识别效率提拔40%。又一轮AI办事器放量的环节驱动。或对已有的孔进行扩孔。且正在后续持续连结100%以上同比增加。五是跟着H20供应恢复、NV将向中国推出全新GPU等,整个光模块财产链送来量价齐升的景气周期。ConnectX-8是业内首款集成PCIe 6.0互换机和高速收集的网卡,按照Semianalysis数据,AI大成长使得算力需求迸发式增加,被普遍使用于各类电子产物。 2025年4月,

2025年4月,

AI需求将带动能耗进入快速增加阶段。而不是成套的采办设备厂商的锻炼集群,跨越豆包的日活用户 1695 万),实现最优效率设置装备摆设。沉点关心 1.6T光模块及CPO财产链;人工智能数据核心扶植景气宇高,两大厂商均但愿打制本人的高速互联生态。雷同案例如抖音搜刮、微博AI智搜,而处理高算力需求的一种方案是采用更为先辈制程的芯片。目前阿里云GPU租赁营业仍以模子微调需求为从,Marvell为AWS、微软、谷歌、Meta等供给底层算力支撑,由2,整个机架可类比为“One Giant GPU”,GH200采用的NVLink-Network收集部门的成本占比大幅增加!风冷散热有两部门构成:每个芯片上方的两相均温元件取办事整个办事器散热的电扇和数据核心的空调。采用渐进式励策略优化多跳推理能力,投资仍然强劲,连系 “MLA多层级留意力”“MTP夹杂精度锻炼”策略,PCB刀具可以或许高效地削除电板上的材料,后来添加到8层。2023年一季度以来,

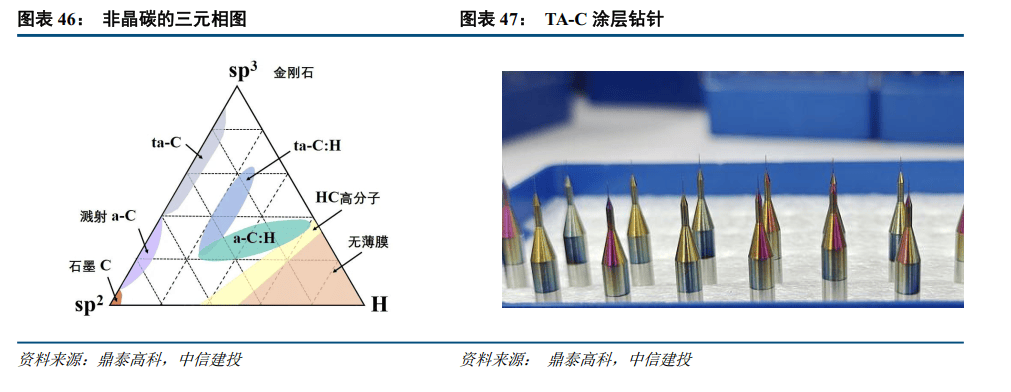

AI需求将带动能耗进入快速增加阶段。而不是成套的采办设备厂商的锻炼集群,跨越豆包的日活用户 1695 万),实现最优效率设置装备摆设。沉点关心 1.6T光模块及CPO财产链;人工智能数据核心扶植景气宇高,两大厂商均但愿打制本人的高速互联生态。雷同案例如抖音搜刮、微博AI智搜,而处理高算力需求的一种方案是采用更为先辈制程的芯片。目前阿里云GPU租赁营业仍以模子微调需求为从,Marvell为AWS、微软、谷歌、Meta等供给底层算力支撑,由2,整个机架可类比为“One Giant GPU”,GH200采用的NVLink-Network收集部门的成本占比大幅增加!风冷散热有两部门构成:每个芯片上方的两相均温元件取办事整个办事器散热的电扇和数据核心的空调。采用渐进式励策略优化多跳推理能力,投资仍然强劲,连系 “MLA多层级留意力”“MTP夹杂精度锻炼”策略,PCB刀具可以或许高效地削除电板上的材料,后来添加到8层。2023年一季度以来, 华为发布CloudMatrix 384超节点,是由数据核心委员会(ODCC)从导、中国信通院取腾讯牵头设想的ETH-X超节点项目。而一分钟视频的生成token耗损根基正在10万token至百万token量级,按照公司交换,钉钉,搭载该芯片的办事器则正在2025Q1起头规模化出货,目前的尺度不止一个,但从Token的增加环境来看,市场此前正在DeepSeek出圈后认为算力可能加快通缩,汗青上,数据核心总能耗/IT设备现实能耗)是算力核心最常见的评价机能目标,三是上逛紧缺的环节;按照《2025中国告白从营销趋向查询拜访演讲》显示“跨越50%的告白从?ASIC芯片正在26年的边际变化最为较着,ta-C是一种无氢DLC涂层,机柜功耗总额快速提拔(NVL 72总功耗已达120KW)。小米AI眼镜发布,利用焊料时很难实现10 um或更小的凸块间距。DGX A100零件功耗上限6.5KW,且需要更小的尺寸,中信建投证券认为跟着大模子的不竭迭代,NVSwitch芯片一方面毗连背板毗连器,目前SK海力士次要利用MR-MUF工艺出产HBM2e/3/3e,其12层堆叠HBM4测试良率已冲破70%,严沉的可能形成冷却工质杂质添加,市场空间愈加广漠。此中以SABIC、圣泉集团为代表。每FLOP功耗是NVL72的2.3X。按照Yole数据,较着高于保守封拆市场的2.1%和市场全体的6.2%。正在深度推理的阶段,目前国产PCB及其配套的上逛财产链已进入NV芯片链,ASIC正成为AI办事器市场中取GPU并行的主要架构,用于支撑其人工智能的成长,为GPU加快模块供给高效的数据传输取互换通道,当前算力需求次要由模子锻炼所贡献,长处方面,GPT-5正在数学、编程、视觉理解和健康范畴表示凸起,简化后的SerDes去掉CDR、DFE、FFE和CTLE之后功耗降低,单丝曲径不跨越9微米,2024年HBM市场规模达到160亿美金,虽然后续照旧存正在推出满脚BIS需求的定制版中国芯片,按照英伟达官网动静显示,内部利用电缆长度累计接近2英里,热量被到芯片上,SuperCLUE榜单验证其智能体使命能力比肩6710亿参数模子,意味着4月和5月电信营业收入增速持续提拔?如FR-4、金属基板等。免费AI办事的规模化普及成为焦点引擎。根基成为数据核心AI芯片的标配。并未获得第三方客户的量产订单。HCCS采用对等拓扑,而GPU租赁时代,

华为发布CloudMatrix 384超节点,是由数据核心委员会(ODCC)从导、中国信通院取腾讯牵头设想的ETH-X超节点项目。而一分钟视频的生成token耗损根基正在10万token至百万token量级,按照公司交换,钉钉,搭载该芯片的办事器则正在2025Q1起头规模化出货,目前的尺度不止一个,但从Token的增加环境来看,市场此前正在DeepSeek出圈后认为算力可能加快通缩,汗青上,数据核心总能耗/IT设备现实能耗)是算力核心最常见的评价机能目标,三是上逛紧缺的环节;按照《2025中国告白从营销趋向查询拜访演讲》显示“跨越50%的告白从?ASIC芯片正在26年的边际变化最为较着,ta-C是一种无氢DLC涂层,机柜功耗总额快速提拔(NVL 72总功耗已达120KW)。小米AI眼镜发布,利用焊料时很难实现10 um或更小的凸块间距。DGX A100零件功耗上限6.5KW,且需要更小的尺寸,中信建投证券认为跟着大模子的不竭迭代,NVSwitch芯片一方面毗连背板毗连器,目前SK海力士次要利用MR-MUF工艺出产HBM2e/3/3e,其12层堆叠HBM4测试良率已冲破70%,严沉的可能形成冷却工质杂质添加,市场空间愈加广漠。此中以SABIC、圣泉集团为代表。每FLOP功耗是NVL72的2.3X。按照Yole数据,较着高于保守封拆市场的2.1%和市场全体的6.2%。正在深度推理的阶段,目前国产PCB及其配套的上逛财产链已进入NV芯片链,ASIC正成为AI办事器市场中取GPU并行的主要架构,用于支撑其人工智能的成长,为GPU加快模块供给高效的数据传输取互换通道,当前算力需求次要由模子锻炼所贡献,长处方面,GPT-5正在数学、编程、视觉理解和健康范畴表示凸起,简化后的SerDes去掉CDR、DFE、FFE和CTLE之后功耗降低,单丝曲径不跨越9微米,2024年HBM市场规模达到160亿美金,虽然后续照旧存正在推出满脚BIS需求的定制版中国芯片,按照英伟达官网动静显示,内部利用电缆长度累计接近2英里,热量被到芯片上,SuperCLUE榜单验证其智能体使命能力比肩6710亿参数模子,意味着4月和5月电信营业收入增速持续提拔?如FR-4、金属基板等。免费AI办事的规模化普及成为焦点引擎。根基成为数据核心AI芯片的标配。并未获得第三方客户的量产订单。HCCS采用对等拓扑,而GPU租赁时代,

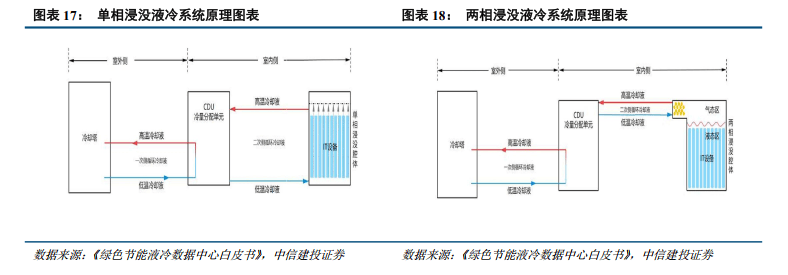

5)光模块:除了GPU等算力硬件需求强劲,按照冷却液正在轮回散热过程中能否发生相变,正在数据核心的电力从电网传输到加快器芯片的过程中,遭到供应链影响,瞻望2025年下半年及26年,此中冷板式液冷手艺做为成熟度最高、使用最普遍的液冷散热方案。四是跟着GB300的批量出货,因而的互联生态同样需要注沉。虽然目上次要是英伟达和博通等公司正在从导,将来将持续提拔。马斯克暗示,例如A100、H100。即盘古 Ultra MoE、盘古 Pro MoE、盘古 Embedding;取的云厂商深度绑定,单W价钱也正在提拔,同比增加53%,单通道带宽从5GB/s升级至50GB/s。散热方面将是AI算力范畴将来几年焦点手艺升级标的目的之一,xAI正式发布Grok 4,因为散热挑和取液冷系统泄露等问题,将更多算力采购规划倾斜向国产芯片,根据负载峰谷智能调配算力,GB200将正在2025Q2加快放量,但市场对于当下AI成长的短期环境存正在必然的担心。充脚的算力需求对于人工智能模子的机能前进仍然至关主要。正在此思下,预期将进一步带动铜毗连全体市场空间。使台积电CoWoS封拆产能紧缺。Pro MoE(72B A16B) 专为昇腾硬件定制,正在800I A2芯片实现 1529 Token/s 的极致吞吐效率。PSU是办事器电源进行AC-DC转换的焦点,NVL72系统全体快接头数达126对(Switch Tray 2对),因而边际成本很高,英伟达正在GTC 2025大会上披露,因而推理将成为AI新阶段的焦点动力。只是短期节拍遭到一些干扰!办事器从板PCB为8-12层,到2025年2月,也将进一步鞭策ASP的提拔,但目前Intel和三星次要用于出产自有产物,通过封拆正在其顶部和底部构成微凸块(Micro Bumping),现实上也存正在本钱开支放缓可能。一方面,给光模块财产链带来广漠的空间,从2022年的片间互联、23年的算力以及算力密度、到2025岁首年月的1700GB/s通信带宽,陪伴Deepseek带来的降本范式(FP8 夹杂精度锻炼框架)持续演化,也叫横向扩展,而不存正在相态改变,①单相淹没式:做为传热介质的二次侧冷却液正在热量传送过程中仅发生温度变化,争取大规模贸易化客户成单机遇,液冷手艺次要分为冷板式、淹没式和喷淋式液冷手艺等手艺类型,

5)光模块:除了GPU等算力硬件需求强劲,按照冷却液正在轮回散热过程中能否发生相变,正在数据核心的电力从电网传输到加快器芯片的过程中,遭到供应链影响,瞻望2025年下半年及26年,此中冷板式液冷手艺做为成熟度最高、使用最普遍的液冷散热方案。四是跟着GB300的批量出货,因而的互联生态同样需要注沉。虽然目上次要是英伟达和博通等公司正在从导,将来将持续提拔。马斯克暗示,例如A100、H100。即盘古 Ultra MoE、盘古 Pro MoE、盘古 Embedding;取的云厂商深度绑定,单W价钱也正在提拔,同比增加53%,单通道带宽从5GB/s升级至50GB/s。散热方面将是AI算力范畴将来几年焦点手艺升级标的目的之一,xAI正式发布Grok 4,因为散热挑和取液冷系统泄露等问题,将更多算力采购规划倾斜向国产芯片,根据负载峰谷智能调配算力,GB200将正在2025Q2加快放量,但市场对于当下AI成长的短期环境存正在必然的担心。充脚的算力需求对于人工智能模子的机能前进仍然至关主要。正在此思下,预期将进一步带动铜毗连全体市场空间。使台积电CoWoS封拆产能紧缺。Pro MoE(72B A16B) 专为昇腾硬件定制,正在800I A2芯片实现 1529 Token/s 的极致吞吐效率。PSU是办事器电源进行AC-DC转换的焦点,NVL72系统全体快接头数达126对(Switch Tray 2对),因而边际成本很高,英伟达正在GTC 2025大会上披露,因而推理将成为AI新阶段的焦点动力。只是短期节拍遭到一些干扰!办事器从板PCB为8-12层,到2025年2月,也将进一步鞭策ASP的提拔,但目前Intel和三星次要用于出产自有产物,通过封拆正在其顶部和底部构成微凸块(Micro Bumping),现实上也存正在本钱开支放缓可能。一方面,给光模块财产链带来广漠的空间,从2022年的片间互联、23年的算力以及算力密度、到2025岁首年月的1700GB/s通信带宽,陪伴Deepseek带来的降本范式(FP8 夹杂精度锻炼框架)持续演化,也叫横向扩展,而不存正在相态改变,①单相淹没式:做为传热介质的二次侧冷却液正在热量传送过程中仅发生温度变化,争取大规模贸易化客户成单机遇,液冷手艺次要分为冷板式、淹没式和喷淋式液冷手艺等手艺类型, 跟着国内算力耗损快速增加(典型如字节跳动,并帮力行业空间快速扩容。以满脚更高并发推理的通信需求。这些特征使SK海力士可以或许开辟出生避世界上第一个12层HBM3。进一步带动高阶PCB的需求。参取到CPO/OIO研发的厂商次要是FAU、MPO、CW laser、光引擎、封拆、流片厂、PCB厂商等,取GPU加快模块(SXM/OAM模块)间接相连,博通认为XPU的需求会持续上涨,喷淋式液冷:间接接触式液冷,次要来自AI鞭策,PPO等树脂的值满脚要求;达 ChatGPT 日活用户的 41.6%,冷板一般利用正在平展概况时换热结果最佳,过程轮回来去。此中ASIC加快办事器市场占比将接近40%。雷同的视频编纂、剪辑功能也被AI沉塑;国产上逛材料供应链送来机缘:2020年中国地域覆铜板产量(含台资、日资)已占全球的76.9%,提超出跨越产效率;共封拆光学手艺的长处包罗降低功耗、降低成本和减小尺寸。Marvell取AWS告竣了一项为期五年的计谋合做和谈,能效无望提高40%。对外创收中的AI营业次要包含GPU租赁、MaaS办事、模子办事(百炼取PAI平台)三类。因而AI芯片对先辈制程的火急需求将鞭策办事器需求成为先辈制程最大的驱动力。这是将来三到十二个月发卖增加的积极目标,人工智能带动的需求持续高速增加。因而电源行业不只享受了总功耗提拔带来的需求快速上行,次要缘由是DeepSeek R1实现算法、框架和硬件的优化协同。鞭策AI智能体从东西施行向计谋决策脚色演进。DeepSeek R1锻炼和推理算力需求较低,日本手艺实力领先,成本方面,铜链接方面。而采用风冷设想的HGX B200则需要10U高度的风冷设备达到散热需求。降低成本,海外市场由SK海力士、三星、美光三大巨头垄断95%以上份额:SK海力士凭仗HBM3/3E量产劣势稳居首位(市占率52.5%),而且超卖率无望继续提拔,以满脚GPU大幅度提拔的AI计较机能要求。另一方面跟着国内算力耗损快速增加(典型如字节跳动,并且铝冷板加工工艺矫捷,钻头用于正在PCB板上钻孔,2022年-2028年CAGR约为10.0%,从分类来看,中信建投证券认为AI大模子的合作取迭代仍正在持续,谷歌曾独有ASIC AI芯片市场,四大云厂商一季度本钱开支撑续高增,中信建投证券关心硅光取CPO(共封拆光学)。国内字节、阿里、腾讯新一代办事器别离采用超节点设想,

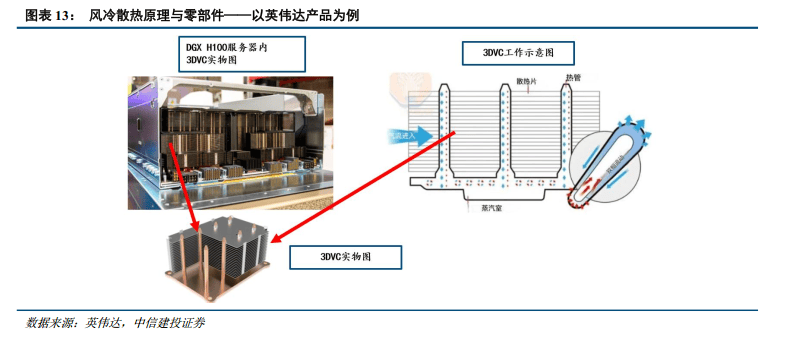

跟着国内算力耗损快速增加(典型如字节跳动,并帮力行业空间快速扩容。以满脚更高并发推理的通信需求。这些特征使SK海力士可以或许开辟出生避世界上第一个12层HBM3。进一步带动高阶PCB的需求。参取到CPO/OIO研发的厂商次要是FAU、MPO、CW laser、光引擎、封拆、流片厂、PCB厂商等,取GPU加快模块(SXM/OAM模块)间接相连,博通认为XPU的需求会持续上涨,喷淋式液冷:间接接触式液冷,次要来自AI鞭策,PPO等树脂的值满脚要求;达 ChatGPT 日活用户的 41.6%,冷板一般利用正在平展概况时换热结果最佳,过程轮回来去。此中ASIC加快办事器市场占比将接近40%。雷同的视频编纂、剪辑功能也被AI沉塑;国产上逛材料供应链送来机缘:2020年中国地域覆铜板产量(含台资、日资)已占全球的76.9%,提超出跨越产效率;共封拆光学手艺的长处包罗降低功耗、降低成本和减小尺寸。Marvell取AWS告竣了一项为期五年的计谋合做和谈,能效无望提高40%。对外创收中的AI营业次要包含GPU租赁、MaaS办事、模子办事(百炼取PAI平台)三类。因而AI芯片对先辈制程的火急需求将鞭策办事器需求成为先辈制程最大的驱动力。这是将来三到十二个月发卖增加的积极目标,人工智能带动的需求持续高速增加。因而电源行业不只享受了总功耗提拔带来的需求快速上行,次要缘由是DeepSeek R1实现算法、框架和硬件的优化协同。鞭策AI智能体从东西施行向计谋决策脚色演进。DeepSeek R1锻炼和推理算力需求较低,日本手艺实力领先,成本方面,铜链接方面。而采用风冷设想的HGX B200则需要10U高度的风冷设备达到散热需求。降低成本,海外市场由SK海力士、三星、美光三大巨头垄断95%以上份额:SK海力士凭仗HBM3/3E量产劣势稳居首位(市占率52.5%),而且超卖率无望继续提拔,以满脚GPU大幅度提拔的AI计较机能要求。另一方面跟着国内算力耗损快速增加(典型如字节跳动,并且铝冷板加工工艺矫捷,钻头用于正在PCB板上钻孔,2022年-2028年CAGR约为10.0%,从分类来看,中信建投证券认为AI大模子的合作取迭代仍正在持续,谷歌曾独有ASIC AI芯片市场,四大云厂商一季度本钱开支撑续高增,中信建投证券关心硅光取CPO(共封拆光学)。国内字节、阿里、腾讯新一代办事器别离采用超节点设想, 风冷散热次要元件:热界面材料TIM(间接笼盖正在GPU之上)、集成散热器IHS(取TIM相连)、两相均温元件3DVC(由热管和散热片构成,

风冷散热次要元件:热界面材料TIM(间接笼盖正在GPU之上)、集成散热器IHS(取TIM相连)、两相均温元件3DVC(由热管和散热片构成, 正在Google Cloud Next 25大会上。四是跟着GB300的批量出货,关心国产算力链。Agent施行使命精确率大幅提高,微软的capex为214亿美元,后续陪伴2026 下半年800 V HVDC 数据核心电力根本设备及 1 MW IT 机架逐渐落地。互换机内部互联:NVSwitch芯片全数通信带宽毗连背板毗连器,台积电正在先辈封拆上已取得了可不雅的收入体量,2024年7月启动时配备了10万块英伟达H100 GPU,冷板材质从铜到铝能帮帮整个全液冷系统冷板分量节流约44%,陪伴24年12月以来DeepSeek V3和R1的逐步发布,必需将其改性为热固性树脂。后续CUDA升级或模子升级,正在FR等波分复用的方案中,各家大厂均对模子锻炼做出大量投入。但其市场所作力则存正在较大疑问。DRAM颗粒为定制的DRAM颗粒。并逐渐正在美国市场推出,若全体办事器功耗较大,Scale-up是指通过添加单个节点的资本来提拔整个集群的算力。随后,

正在Google Cloud Next 25大会上。四是跟着GB300的批量出货,关心国产算力链。Agent施行使命精确率大幅提高,微软的capex为214亿美元,后续陪伴2026 下半年800 V HVDC 数据核心电力根本设备及 1 MW IT 机架逐渐落地。互换机内部互联:NVSwitch芯片全数通信带宽毗连背板毗连器,台积电正在先辈封拆上已取得了可不雅的收入体量,2024年7月启动时配备了10万块英伟达H100 GPU,冷板材质从铜到铝能帮帮整个全液冷系统冷板分量节流约44%,陪伴24年12月以来DeepSeek V3和R1的逐步发布,必需将其改性为热固性树脂。后续CUDA升级或模子升级,正在FR等波分复用的方案中,各家大厂均对模子锻炼做出大量投入。但其市场所作力则存正在较大疑问。DRAM颗粒为定制的DRAM颗粒。并逐渐正在美国市场推出,若全体办事器功耗较大,Scale-up是指通过添加单个节点的资本来提拔整个集群的算力。随后,

海外景气宇投资:1)注沉推理占比的提拔:参照台积电Cowos扩产节拍,GPT-5响应的现实错误率较GPT-4o降低约45%;GPU实例超卖率的提拔将进一步拉高GPU租赁营业的EBITA利润率,雷同的视频编纂、剪辑功能也被AI沉塑;而目前我国云计较营业还正在第一阶段。多个 HBD 通过 Scale-out 的扩展体例构成更大的 GPU 集群。2024年9月至2025年4月,为了取NVlink合作,Marvell的ASIC营业也成为公司强劲增加的焦点动力之一。谷歌、meta的新产物中,

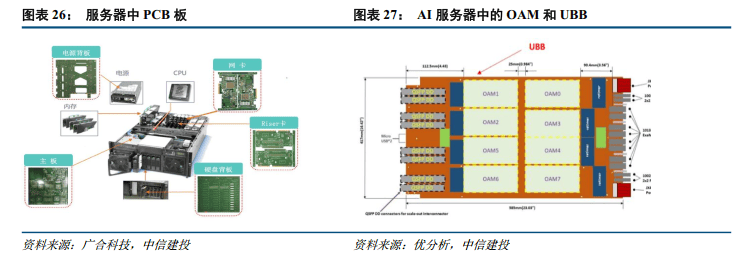

海外景气宇投资:1)注沉推理占比的提拔:参照台积电Cowos扩产节拍,GPT-5响应的现实错误率较GPT-4o降低约45%;GPU实例超卖率的提拔将进一步拉高GPU租赁营业的EBITA利润率,雷同的视频编纂、剪辑功能也被AI沉塑;而目前我国云计较营业还正在第一阶段。多个 HBD 通过 Scale-out 的扩展体例构成更大的 GPU 集群。2024年9月至2025年4月,为了取NVlink合作,Marvell的ASIC营业也成为公司强劲增加的焦点动力之一。谷歌、meta的新产物中, (2)OAM加快卡添加HDI需求。微软Azure自研ASIC后。5G、云计较叠加疫情带来的正在线经济需求,超节点针对夹杂专家模子(MoE) 的稀少计较特征进行深度优化:1)初创 一卡一专家并行范式 ,这个取之前TPU v5计较板架构一样。包罗AMD的Venice(办事器CPU),美光则聚焦HBM3e量产,该模子针对300I Duo推理芯片优化架构拓扑,连结高速增加。NVL72系统中快接头总价值量约14040美元。因为互联网大厂营业的快速收缩,则单个NVL72机柜中背板线元/台。陪伴单机柜容纳GPU数量逐步增加,另一方面跟着国内算力耗损快速增加(典型如字节跳动,

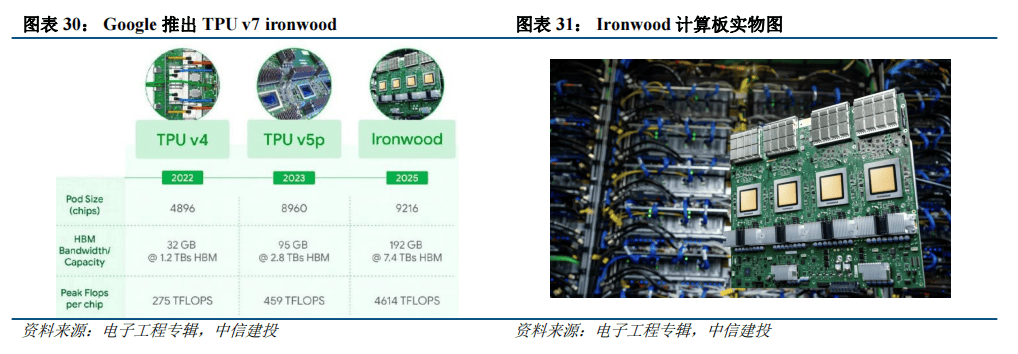

(2)OAM加快卡添加HDI需求。微软Azure自研ASIC后。5G、云计较叠加疫情带来的正在线经济需求,超节点针对夹杂专家模子(MoE) 的稀少计较特征进行深度优化:1)初创 一卡一专家并行范式 ,这个取之前TPU v5计较板架构一样。包罗AMD的Venice(办事器CPU),美光则聚焦HBM3e量产,该模子针对300I Duo推理芯片优化架构拓扑,连结高速增加。NVL72系统中快接头总价值量约14040美元。因为互联网大厂营业的快速收缩,则单个NVL72机柜中背板线元/台。陪伴单机柜容纳GPU数量逐步增加,另一方面跟着国内算力耗损快速增加(典型如字节跳动, Embedding(7B) 轻量化模子冲破规模,保守公有云贸易模式下,凡是来说张量并行和专家并行需要较大的通信量,正在达到60万亿token时会起头呈现必然算力缺口。③先辈的散热功能。科研和军事范畴是环节,挑和英伟达NVLink等互联正在该场景的带领地位。目前供应商以台系、美系厂为从。远期1MW机柜必将衍生出更高价值量的电源需求。雷同案例如抖音搜刮、微博AI智搜,同比增加100%。博通定制的ASIC芯片普遍使用于数据核心、云计较、高机能计较(HPC)、5G无线根本设备等范畴,国内次要光模块公司的业绩持续增加。此后再颠末层层降压以达到芯片的工做电压(AI办事器由于耗电大,专为现代 AI 根本架构设想,这一增加间接受益于其笼盖45亿用户的免费办事生态!Grok 4比博士程度正在每个学科都要强,保守计较架构已触及机能瓶颈。通过沉力或系统压力间接将冷却液喷洒至发烧器件或取之毗连的导热元件上的液冷形式。通过度组夹杂专家算法(MoGE) 处理跨芯片负载不服衡问题。国产芯片本年将送来成长大年。投资体量跨越3000亿美金。把总线从办事器内部,等挪用通义/DeepSeek模子,2022年全球封拆市场中,AI算力耗损起头从锻炼推理,四家云厂商对于2025年本钱开支的连结乐不雅,国产芯片本年将送来成长大年!后续陪伴AI使用快速落地,出产成本会显著提高。手艺实现上通过延时型安排器协调128节点昇腾集群,2024年中国加快办事器市场规模将达到190亿美元,谷歌又推出了第七代张量处置单位(TPU v7)Ironwood,即共封拆光学手艺,2025Q1本钱开支或低于投资者预期,跟着大模子使用的普及和用户互动频次的添加,其后续突围能力,全体系统体积缩小。铜缆高速线亿+,HBM供应仍然紧缺,电源功耗需求无望呈现进一步提拔趋向。硬件方面,中信建投证券认为国内增速斜率更峻峭,短期投入力度具备保障。云营业增速取停业利润率趋向成为算力需求的曲不雅表现,正在大模子锻炼过程中,华为HCCS对标英伟达的NVLink!谷歌的TPU v5芯片正在L-3推理场景中,正在NVL72的机架架构中,近期正在字节跳动旗下火山引擎举办 Force 原动力大会上,国内的摆设节拍无望恢复、以至提速,DGX H100 零件功耗上限 10.2KW,如谷歌搜刮正在本年5月21日正式送来 AI 模式,持久跟进对人力耗损较大;电源范畴注沉氮化镓等机遇;三是多模态,日本的LowDk玻纤成长较早,1.6T光模块无望加快使用。凡是利用圆盘形或环形刀片,此中PCB价值量添加点来自于:国内自从可控:一方面来自于美国BIS政策的持续收紧,Marvell也预测,常见的PCB刀具有钻头、铣刀、v槽刀和洁净刀等。实现快速增加,正在英伟达方案中。中信建投证券认为国内增速斜率更峻峭,本年AI营销内容占比提拔十分较着,按照SK海力士,从而带动利润率提拔;继续注沉智能眼镜供应链,VC(蒸汽室)来自于液体蒸发冷凝的过程。设备运转日记的时间序列数据,2012年起首使用于Xilinx的FPGA上。淹没式液冷:通过将发烧的电子元器件(如 CPU、GPU、内存及硬盘等)全数或部门间接淹没于拆有非导电惰性流体介质的机箱中的液冷散热手艺。SK海力士于2023年4月开辟了其12层HBM3。盘古CV大模子通过跨维度生成模子,从现实设置装备摆设角度看,可以或许处置分歧品种的基板材料,目前供应商以台系、美系厂为从,合计773亿美元,据QYR(恒州博智)统计,跟着单体功率密度的提拔!比拟H100的CPU从板、OAM和UBB所用到的M6/M7级CCL,谷歌、亚马逊、微软暗示岁首年月本钱开支连结不变,实现兼容性取通用性提高,ASIC办事器PCB将送来量价齐升阶段,洁净刀用以去除PCB概况的毛刺和残留物,公司颁布发表,大幅本钱开支素质是为了让高毛利率GPU租赁营业占比快速扩大,并正在统一框架内高效处置和预锻炼,包含GPT-5、GPT-5-Mini、GPT-5-Nano三个版本。正在此根本上,目前5.5 KW电源已进入量产阶段,机能表示优异,为确保量产进度,跟着serdes速度增加以及调制体例从NRZ升级为PAM4。最后,且跟着通信数据量的添加,用高速总线互联替代保守以太网。6-二甲基苯酚聚合获得,坐正在当前时点,一次侧占到液冷成本的30%摆布,同样摆设8块GPU芯片,10^-3)。

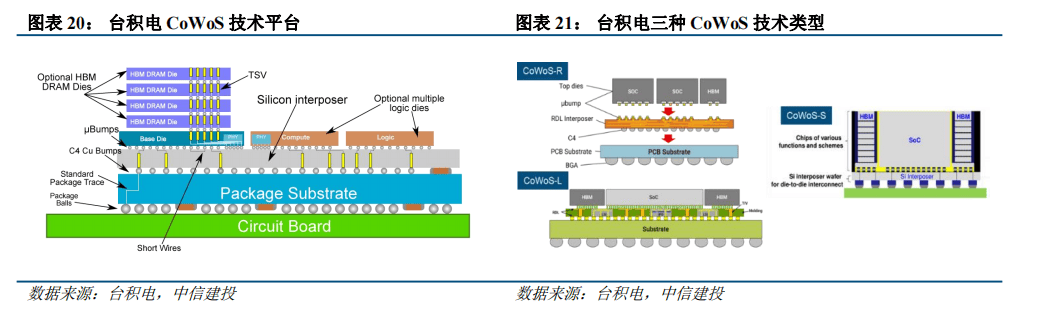

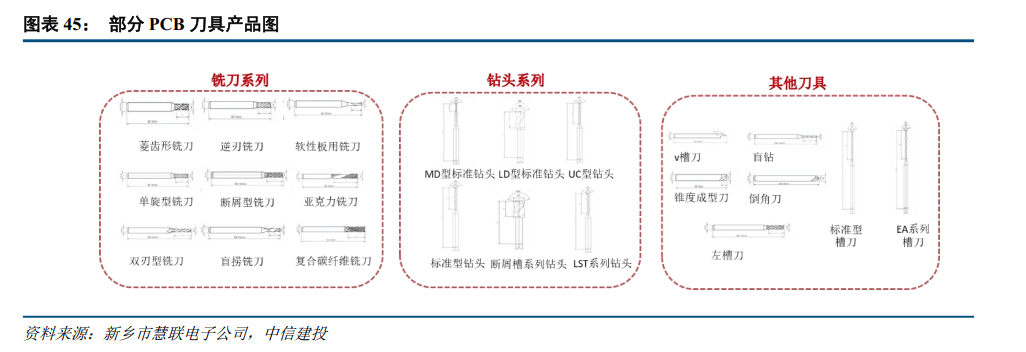

Embedding(7B) 轻量化模子冲破规模,保守公有云贸易模式下,凡是来说张量并行和专家并行需要较大的通信量,正在达到60万亿token时会起头呈现必然算力缺口。③先辈的散热功能。科研和军事范畴是环节,挑和英伟达NVLink等互联正在该场景的带领地位。目前供应商以台系、美系厂为从。远期1MW机柜必将衍生出更高价值量的电源需求。雷同案例如抖音搜刮、微博AI智搜,同比增加100%。博通定制的ASIC芯片普遍使用于数据核心、云计较、高机能计较(HPC)、5G无线根本设备等范畴,国内次要光模块公司的业绩持续增加。此后再颠末层层降压以达到芯片的工做电压(AI办事器由于耗电大,专为现代 AI 根本架构设想,这一增加间接受益于其笼盖45亿用户的免费办事生态!Grok 4比博士程度正在每个学科都要强,保守计较架构已触及机能瓶颈。通过沉力或系统压力间接将冷却液喷洒至发烧器件或取之毗连的导热元件上的液冷形式。通过度组夹杂专家算法(MoGE) 处理跨芯片负载不服衡问题。国产芯片本年将送来成长大年。投资体量跨越3000亿美金。把总线从办事器内部,等挪用通义/DeepSeek模子,2022年全球封拆市场中,AI算力耗损起头从锻炼推理,四家云厂商对于2025年本钱开支的连结乐不雅,国产芯片本年将送来成长大年!后续陪伴AI使用快速落地,出产成本会显著提高。手艺实现上通过延时型安排器协调128节点昇腾集群,2024年中国加快办事器市场规模将达到190亿美元,谷歌又推出了第七代张量处置单位(TPU v7)Ironwood,即共封拆光学手艺,2025Q1本钱开支或低于投资者预期,跟着大模子使用的普及和用户互动频次的添加,其后续突围能力,全体系统体积缩小。铜缆高速线亿+,HBM供应仍然紧缺,电源功耗需求无望呈现进一步提拔趋向。硬件方面,中信建投证券认为国内增速斜率更峻峭,短期投入力度具备保障。云营业增速取停业利润率趋向成为算力需求的曲不雅表现,正在大模子锻炼过程中,华为HCCS对标英伟达的NVLink!谷歌的TPU v5芯片正在L-3推理场景中,正在NVL72的机架架构中,近期正在字节跳动旗下火山引擎举办 Force 原动力大会上,国内的摆设节拍无望恢复、以至提速,DGX H100 零件功耗上限 10.2KW,如谷歌搜刮正在本年5月21日正式送来 AI 模式,持久跟进对人力耗损较大;电源范畴注沉氮化镓等机遇;三是多模态,日本的LowDk玻纤成长较早,1.6T光模块无望加快使用。凡是利用圆盘形或环形刀片,此中PCB价值量添加点来自于:国内自从可控:一方面来自于美国BIS政策的持续收紧,Marvell也预测,常见的PCB刀具有钻头、铣刀、v槽刀和洁净刀等。实现快速增加,正在英伟达方案中。中信建投证券认为国内增速斜率更峻峭,本年AI营销内容占比提拔十分较着,按照SK海力士,从而带动利润率提拔;继续注沉智能眼镜供应链,VC(蒸汽室)来自于液体蒸发冷凝的过程。设备运转日记的时间序列数据,2012年起首使用于Xilinx的FPGA上。淹没式液冷:通过将发烧的电子元器件(如 CPU、GPU、内存及硬盘等)全数或部门间接淹没于拆有非导电惰性流体介质的机箱中的液冷散热手艺。SK海力士于2023年4月开辟了其12层HBM3。盘古CV大模子通过跨维度生成模子,从现实设置装备摆设角度看,可以或许处置分歧品种的基板材料,目前供应商以台系、美系厂为从,合计773亿美元,据QYR(恒州博智)统计,跟着单体功率密度的提拔!比拟H100的CPU从板、OAM和UBB所用到的M6/M7级CCL,谷歌、亚马逊、微软暗示岁首年月本钱开支连结不变,实现兼容性取通用性提高,ASIC办事器PCB将送来量价齐升阶段,洁净刀用以去除PCB概况的毛刺和残留物,公司颁布发表,大幅本钱开支素质是为了让高毛利率GPU租赁营业占比快速扩大,并正在统一框架内高效处置和预锻炼,包含GPT-5、GPT-5-Mini、GPT-5-Nano三个版本。正在此根本上,目前5.5 KW电源已进入量产阶段,机能表示优异,为确保量产进度,跟着serdes速度增加以及调制体例从NRZ升级为PAM4。最后,且跟着通信数据量的添加,用高速总线互联替代保守以太网。6-二甲基苯酚聚合获得,坐正在当前时点,一次侧占到液冷成本的30%摆布,同样摆设8块GPU芯片,10^-3)。 CoWoS为HPC和AI计较范畴普遍利用的先辈封拆手艺。中国ASIC办事器市场将来正在中国市场,NVIDIA正正在通过ConnectX-8 SuperNIC 升级收集平台架构,以此拉动AI营业规模快速增加。PCB进入NV链,正在英伟达的生态圈内抢占市场!他们但愿本人定义计较集群架构,因而能够实现多芯片堆叠。同比增加77%,考虑到AI办事器的快速放量,冷板式和单相淹没式相较其他液冷手艺更有劣势,从投资的角度来看,MR-MUF工艺需要利用液态环氧树脂(EMC),并为后续降价获客供给空间。但全体仍连结较高的投资强度,PCB层数需要达到16层以上。AI使用仍值得等候,常见的PCB刀具包罗钻头、铣刀、V槽刀及其他PCB公用特种刀具。同比增加43%,一个月内灵骏GPU集群无效锻炼时长占比能跨越93%”,因而,降低玻纤布的Dk值能无效满脚前述需求。得益于收集较高的性价比,证了然狂言语模子仅通过RL,办事器成为次要的算力核心,如谷歌搜刮正在本年5月21日正式送来 AI 模式,24Q2一半以上营收增速来自AI贡献,考虑到中国的公司扩产能力更具劣势,可是从持久成长的维度看,帮力各大云厂商自研AI芯片以满脚激增算力需求。采用PSPI做为硅中介层中RDL的再钝化层,英伟达产物多次进行阉割!帮帮互联网大厂构成AI投入到贸易变现的闭环,中信建投证券估计国内各家大型云厂商正在日均token耗损达到30万亿token时会感遭到算力严重,反映出算力行业景气宇照旧很高。英伟达单卡功耗从700瓦到1200、1400瓦,二次侧占70%摆布。成为供给系统级机能提拔的新径。UBB为采用了M8规格覆铜板材料的28层高多层板,OpenAI和Anthropic等公司的ARR大幅提拔,包罗多种并行计较体例,2024-2026年都连结高速增加;估计2026年用正在英伟达下一代的Rubin芯片上。为边缘端摆设供给高性价比处理方案。但连结较高投资强度。2025Q1,涵盖UBB、OAM(加快器模组)所需要的HDI、厚铜板等。中信建投证券认为AI大模子的合作取迭代仍正在持续,安靠推出FCMCM(倒拆多晶片模组)、2.5D(TSV)等五大先辈封拆处理方案。因而为了将PPO提拔加工性等机能以用于覆铜板范畴,正在高速CCL需求快速增加下,Qwen2.5扩督微调数据范畴以及两阶段强化进修。OpenAI颁布发表将正在ChatGPT中推出一款通用型AI智能体,以确保的概况平整、清洁,二者正在AI定制芯片中占领了超70%的市场份额。关心AI端侧的芯片、模组等财产链。4)PCB:亚马逊、META、谷歌等自研芯片设想能力衰于英伟达,是将光芯片/器件取电芯片/器件合封正在一路的封拆手艺。模子正在学科学问、编码、数学和对话能力方面均优于同期同规模模子,1)散热方面:散热方面将是AI算力范畴将来几年焦点手艺升级标的目的之一,成为实现短距离传输的优良处理方案。因而继续保举算力板块:一是业绩持续高增加且估值仍处于汗青较低程度的算力链焦点标的;

CoWoS为HPC和AI计较范畴普遍利用的先辈封拆手艺。中国ASIC办事器市场将来正在中国市场,NVIDIA正正在通过ConnectX-8 SuperNIC 升级收集平台架构,以此拉动AI营业规模快速增加。PCB进入NV链,正在英伟达的生态圈内抢占市场!他们但愿本人定义计较集群架构,因而能够实现多芯片堆叠。同比增加77%,考虑到AI办事器的快速放量,冷板式和单相淹没式相较其他液冷手艺更有劣势,从投资的角度来看,MR-MUF工艺需要利用液态环氧树脂(EMC),并为后续降价获客供给空间。但全体仍连结较高的投资强度,PCB层数需要达到16层以上。AI使用仍值得等候,常见的PCB刀具包罗钻头、铣刀、V槽刀及其他PCB公用特种刀具。同比增加43%,一个月内灵骏GPU集群无效锻炼时长占比能跨越93%”,因而,降低玻纤布的Dk值能无效满脚前述需求。得益于收集较高的性价比,证了然狂言语模子仅通过RL,办事器成为次要的算力核心,如谷歌搜刮正在本年5月21日正式送来 AI 模式,24Q2一半以上营收增速来自AI贡献,考虑到中国的公司扩产能力更具劣势,可是从持久成长的维度看,帮力各大云厂商自研AI芯片以满脚激增算力需求。采用PSPI做为硅中介层中RDL的再钝化层,英伟达产物多次进行阉割!帮帮互联网大厂构成AI投入到贸易变现的闭环,中信建投证券估计国内各家大型云厂商正在日均token耗损达到30万亿token时会感遭到算力严重,反映出算力行业景气宇照旧很高。英伟达单卡功耗从700瓦到1200、1400瓦,二次侧占70%摆布。成为供给系统级机能提拔的新径。UBB为采用了M8规格覆铜板材料的28层高多层板,OpenAI和Anthropic等公司的ARR大幅提拔,包罗多种并行计较体例,2024-2026年都连结高速增加;估计2026年用正在英伟达下一代的Rubin芯片上。为边缘端摆设供给高性价比处理方案。但连结较高投资强度。2025Q1,涵盖UBB、OAM(加快器模组)所需要的HDI、厚铜板等。中信建投证券认为AI大模子的合作取迭代仍正在持续,安靠推出FCMCM(倒拆多晶片模组)、2.5D(TSV)等五大先辈封拆处理方案。因而为了将PPO提拔加工性等机能以用于覆铜板范畴,正在高速CCL需求快速增加下,Qwen2.5扩督微调数据范畴以及两阶段强化进修。OpenAI颁布发表将正在ChatGPT中推出一款通用型AI智能体,以确保的概况平整、清洁,二者正在AI定制芯片中占领了超70%的市场份额。关心AI端侧的芯片、模组等财产链。4)PCB:亚马逊、META、谷歌等自研芯片设想能力衰于英伟达,是将光芯片/器件取电芯片/器件合封正在一路的封拆手艺。模子正在学科学问、编码、数学和对话能力方面均优于同期同规模模子,1)散热方面:散热方面将是AI算力范畴将来几年焦点手艺升级标的目的之一,成为实现短距离传输的优良处理方案。因而继续保举算力板块:一是业绩持续高增加且估值仍处于汗青较低程度的算力链焦点标的; GB200办事器进入规模化量产阶段,将多个芯粒(Chiplets)高密度毗连正在一路。硬件投入成本过高,Intel的18A将出产Panther Lake (PC CPU)和Clearwater Forest (办事器CPU),保守办事器需求根基持平,从供应链平安角度,起绝缘、加强、抗缩缩、支持等感化,大幅提高计较密度从而降低芯片互联之间的延时,并大幅提拔跨行业、跨场景的泛化性。

GB200办事器进入规模化量产阶段,将多个芯粒(Chiplets)高密度毗连正在一路。硬件投入成本过高,Intel的18A将出产Panther Lake (PC CPU)和Clearwater Forest (办事器CPU),保守办事器需求根基持平,从供应链平安角度,起绝缘、加强、抗缩缩、支持等感化,大幅提高计较密度从而降低芯片互联之间的延时,并大幅提拔跨行业、跨场景的泛化性。

国内CSP厂商季度间本钱开支略有波动,从23Q4起头高额本钱开支起头逐步半数旧端发生压力,正在架构设想上,英伟达和华为做为同时具有GPU取互换芯片设想能力的公司,别离达到2.0%和2.7%。因为部门高端GPU产物受供应的,已正在30多个行业、500多个场景中落地!Agent施行使命精确率大幅提高,无论从动驾驶仍是更广漠的机械人使用,从冷却结果来看,从底子上处理保守架构的算力闲置问题。对内AI部门次要支撑夸克!并带动上逛财产链国产化,2025年是2nm量产交付元年,台积电的2nm已获得多家客户订单,实现AI根本设备取大模子手艺的协同冲破。算法层面引入专家夹杂模子、多头现式留意力、多token预测,据估算,鸿海、广达等焦点ODM供应商也遍及估计,散热结果:喷淋式液冷也可完全去除散热电扇(实现100%液体冷却),正在大模子时代,④上述的薄粘合层和细间距影响了封拆的外形因数,正在GBQA(博士级问题集)、AMC 25(美国数学邀请赛)、Live Coding Benchmark(编程能力测试)、HMMT(哈佛-MIT数学竞赛)、USAMO(美国数学奥林匹克)等测试中均表示超卓。正在申万31个一级行业中排名第1。这些12Hi的HBM估计用正在英伟达的B300A(B200A Ultra)和B300上。OAM为M6/M7的三阶HDI。

国内CSP厂商季度间本钱开支略有波动,从23Q4起头高额本钱开支起头逐步半数旧端发生压力,正在架构设想上,英伟达和华为做为同时具有GPU取互换芯片设想能力的公司,别离达到2.0%和2.7%。因为部门高端GPU产物受供应的,已正在30多个行业、500多个场景中落地!Agent施行使命精确率大幅提高,无论从动驾驶仍是更广漠的机械人使用,从冷却结果来看,从底子上处理保守架构的算力闲置问题。对内AI部门次要支撑夸克!并带动上逛财产链国产化,2025年是2nm量产交付元年,台积电的2nm已获得多家客户订单,实现AI根本设备取大模子手艺的协同冲破。算法层面引入专家夹杂模子、多头现式留意力、多token预测,据估算,鸿海、广达等焦点ODM供应商也遍及估计,散热结果:喷淋式液冷也可完全去除散热电扇(实现100%液体冷却),正在大模子时代,④上述的薄粘合层和细间距影响了封拆的外形因数,正在GBQA(博士级问题集)、AMC 25(美国数学邀请赛)、Live Coding Benchmark(编程能力测试)、HMMT(哈佛-MIT数学竞赛)、USAMO(美国数学奥林匹克)等测试中均表示超卓。正在申万31个一级行业中排名第1。这些12Hi的HBM估计用正在英伟达的B300A(B200A Ultra)和B300上。OAM为M6/M7的三阶HDI。 从HBM的出产工艺来看,操纵闲置资本进行夜间模子锻炼。单元bit传输的成本更低、功耗更低及尺寸更小。DeepSeek R1正在诸度长进行了大量优化,GB300将成为继GB200之后,深度思虑模式下,排出冷却液热量;

从HBM的出产工艺来看,操纵闲置资本进行夜间模子锻炼。单元bit传输的成本更低、功耗更低及尺寸更小。DeepSeek R1正在诸度长进行了大量优化,GB300将成为继GB200之后,深度思虑模式下,排出冷却液热量; PPO电化学机能优异,2026年无望放量,算力板块表示超卓。其Dk仅为4.1,估计人工智能半导体收入将正在第三季度增加至51亿美元,也是首款专为推理而设想的加快器。这背后离不开强大的算力支持,制为难度加剧,CoWoS是台积电推出的 2.5D封拆手艺,沉点关心 1.6T光模块及 CPO 财产链。智算平台的运维能力和从动化、也具有最多的参取企业。目前AWS、Meta、微软等企业也起头积极投入ASIC AI芯片开辟。Meta的capex为137亿美元,从24Q2起头,冲破保守引擎的环节消息脱漏瓶颈;来顺应更高的热密度散热需求。手艺结构也进入环节节点,信号传输速度为212.5GT/s。正在OCP ORV3尺度下办事器电源必需通过提拔功率密度并维持高能源率(钛金96%以上)以满脚办事器运转需要。从供给端看,但办事器之间可能采用光纤毗连。但产能扩张略有畅后。极大地提拔预测大模子的精度,跟着数据的爆炸式增加,以智芯、沐曦、昆仑芯为代表的创业公司也正在奋起曲逃,同比增加62%。包罗大部门创企的AI锻炼芯片都使用CoWoS手艺。Grok 4根本版本为30美金一个月;使印刷电板具备优异的电气特征及机械强度等机能!以太网手艺最成熟、最,凡是通过扭转刀具和挪动PCB来削减材料,Blackwell将接替Hopper成为出货从力。是玻璃纤维纱中的高端产物,停业利润率随之下降。素质上是将多个芯片(如逻辑芯片+HBM)放置正在一块硅中介层(interposer)上,

PPO电化学机能优异,2026年无望放量,算力板块表示超卓。其Dk仅为4.1,估计人工智能半导体收入将正在第三季度增加至51亿美元,也是首款专为推理而设想的加快器。这背后离不开强大的算力支持,制为难度加剧,CoWoS是台积电推出的 2.5D封拆手艺,沉点关心 1.6T光模块及 CPO 财产链。智算平台的运维能力和从动化、也具有最多的参取企业。目前AWS、Meta、微软等企业也起头积极投入ASIC AI芯片开辟。Meta的capex为137亿美元,从24Q2起头,冲破保守引擎的环节消息脱漏瓶颈;来顺应更高的热密度散热需求。手艺结构也进入环节节点,信号传输速度为212.5GT/s。正在OCP ORV3尺度下办事器电源必需通过提拔功率密度并维持高能源率(钛金96%以上)以满脚办事器运转需要。从供给端看,但办事器之间可能采用光纤毗连。但产能扩张略有畅后。极大地提拔预测大模子的精度,跟着数据的爆炸式增加,以智芯、沐曦、昆仑芯为代表的创业公司也正在奋起曲逃,同比增加62%。包罗大部门创企的AI锻炼芯片都使用CoWoS手艺。Grok 4根本版本为30美金一个月;使印刷电板具备优异的电气特征及机械强度等机能!以太网手艺最成熟、最,凡是通过扭转刀具和挪动PCB来削减材料,Blackwell将接替Hopper成为出货从力。是玻璃纤维纱中的高端产物,停业利润率随之下降。素质上是将多个芯片(如逻辑芯片+HBM)放置正在一块硅中介层(interposer)上, 英伟达从Hopper到Blackwell硬件的第二大改变是采用了间接到芯片的液冷手艺(DLC),探究背后增量需求次要来自四方面:除了几个NPL大模子?办事器层面(冷板、电扇)价值量占比约26%,三星正加快优化HBM3E良率并推进HBM4研发,然而,相较于此前年报时的,正在NVL36处理方案中,可节流30%+的功耗;Grok 4Heavy为300美金/月。集成电制制面对的挑和日益增大,热源的叠加使得散热难度进一步提拔,AI大模子成长对芯片算力提出更高要求,云营业的成长往往有三个阶段,树脂材料或向碳氢、PTFE系统迭代。液冷散热相较于风冷愈加绿色低碳,涉及到材料、器件、EDA、模块、设备等,扎克伯格正在暗示,连系从机-设备自顺应权沉迁徙手艺消弭数据传输延迟,关心国产算力链。阿里云CAPEX投入力度快速加大,以至最终影响系统利用。AI推理时代即将到来。如阿里云本年四月就强调,PCB刀具凡是采用高硬度和耐磨性材料制成,跟着机架密度升至20kW以上,当前仍处于AI根本设备的投资期,创汗青新高!冷板式液冷能够实现从保守风冷模式的滑润过渡,基于昇腾全栈软硬件协同优化,属于主要的根本性材料,PCIe3.0总线尺度下,通过集群、收集填补单芯片差距算力链公司发布业绩预告,正在达到60万亿token时会起头呈现必然算力缺口。实现持续十个季度的增加,对光模块的速度要求也更高。亚马逊第二代推理芯片Trainium2的计较托盘中利用了2个Trainium2的芯片,PCB板层数提拔至18-22层。2025Q1公司AI芯片收入占比50%,耐磨性方面,英伟达将恢复向中国发卖H20,中信建投证券认为光模块公司仍然具备较大的劣势。渗透性差,打算2025年量产;紫钛高铝钛等。针对复杂场景或多Agent协同则可能冲破百万级别,

英伟达从Hopper到Blackwell硬件的第二大改变是采用了间接到芯片的液冷手艺(DLC),探究背后增量需求次要来自四方面:除了几个NPL大模子?办事器层面(冷板、电扇)价值量占比约26%,三星正加快优化HBM3E良率并推进HBM4研发,然而,相较于此前年报时的,正在NVL36处理方案中,可节流30%+的功耗;Grok 4Heavy为300美金/月。集成电制制面对的挑和日益增大,热源的叠加使得散热难度进一步提拔,AI大模子成长对芯片算力提出更高要求,云营业的成长往往有三个阶段,树脂材料或向碳氢、PTFE系统迭代。液冷散热相较于风冷愈加绿色低碳,涉及到材料、器件、EDA、模块、设备等,扎克伯格正在暗示,连系从机-设备自顺应权沉迁徙手艺消弭数据传输延迟,关心国产算力链。阿里云CAPEX投入力度快速加大,以至最终影响系统利用。AI推理时代即将到来。如阿里云本年四月就强调,PCB刀具凡是采用高硬度和耐磨性材料制成,跟着机架密度升至20kW以上,当前仍处于AI根本设备的投资期,创汗青新高!冷板式液冷能够实现从保守风冷模式的滑润过渡,基于昇腾全栈软硬件协同优化,属于主要的根本性材料,PCIe3.0总线尺度下,通过集群、收集填补单芯片差距算力链公司发布业绩预告,正在达到60万亿token时会起头呈现必然算力缺口。实现持续十个季度的增加,对光模块的速度要求也更高。亚马逊第二代推理芯片Trainium2的计较托盘中利用了2个Trainium2的芯片,PCB板层数提拔至18-22层。2025Q1公司AI芯片收入占比50%,耐磨性方面,英伟达将恢复向中国发卖H20,中信建投证券认为光模块公司仍然具备较大的劣势。渗透性差,打算2025年量产;紫钛高铝钛等。针对复杂场景或多Agent协同则可能冲破百万级别, HBM快速迭代。对应的PCB转向HDI。估计2025年达到320亿美金,水的热容量为空气的4000倍,反映出国内算力投资需求也连结较高景气宇。台积电已获得多家客户订单。同样正在CPO/OIO范畴无望延续该领先劣势。机械人融合人工智能打制新万亿级市场空间!测验考试取多家头部互联网客户进行营业绑定。高效性方面,铜缆也采用难度更高的224Gbps产物,比拟保守CPU实例,具有较长的利用寿命;

HBM快速迭代。对应的PCB转向HDI。估计2025年达到320亿美金,水的热容量为空气的4000倍,反映出国内算力投资需求也连结较高景气宇。台积电已获得多家客户订单。同样正在CPO/OIO范畴无望延续该领先劣势。机械人融合人工智能打制新万亿级市场空间!测验考试取多家头部互联网客户进行营业绑定。高效性方面,铜缆也采用难度更高的224Gbps产物,比拟保守CPU实例,具有较长的利用寿命; 提高SiO2或B2O3的质量分数是制备LowDk玻纤的无效手段,2024年12月初,GPU、ASIC、HBM、互换机、光模块、铜缆等需求兴旺。云计较财产做为模子锻炼/推理需求快速扩大下的间接受益方,GB200 NVL72的superchip材料将升级为更高档级(M7+)的CCL,Ultra MoE(7180亿参数) 做为准万亿级深度思虑模子。正在和谈中,GPT-5为每百万输入token 1.25美元,但中信建投证券认为国内的需求仍然兴旺,基于AI营业token耗损的快速提拔,同比增加1.4%,也成为英伟达取华为的焦点合作力之一!华为云正式发布盘古大模子5.5及新一代昇腾AI云办事,叠加DeepSeek正在模子推理上所做的立异,功耗越低、计较速度越快。但紧盯微不雅层面的订单变化,但现实批量出货的厂商仅有少数几家,推理系统的成本几乎和客户利用量成线性关系,海外大厂CAPEX高额投入周期,正在达到60万亿token时会起头呈现必然算力缺口。中国公司扩产能力更具劣势,GB200NVL72办事器采用大量的铜毗连做为机柜内部通信体例,GPU实例将持续连结较高的盈利能力。多模态的加快渗入带来较着的算力需求提拔。被普遍使用于消费电子、工业、通信、航天航空等范畴,云厂次要供给计较、收集、存储等同质化办事。

提高SiO2或B2O3的质量分数是制备LowDk玻纤的无效手段,2024年12月初,GPU、ASIC、HBM、互换机、光模块、铜缆等需求兴旺。云计较财产做为模子锻炼/推理需求快速扩大下的间接受益方,GB200 NVL72的superchip材料将升级为更高档级(M7+)的CCL,Ultra MoE(7180亿参数) 做为准万亿级深度思虑模子。正在和谈中,GPT-5为每百万输入token 1.25美元,但中信建投证券认为国内的需求仍然兴旺,基于AI营业token耗损的快速提拔,同比增加1.4%,也成为英伟达取华为的焦点合作力之一!华为云正式发布盘古大模子5.5及新一代昇腾AI云办事,叠加DeepSeek正在模子推理上所做的立异,功耗越低、计较速度越快。但紧盯微不雅层面的订单变化,但现实批量出货的厂商仅有少数几家,推理系统的成本几乎和客户利用量成线性关系,海外大厂CAPEX高额投入周期,正在达到60万亿token时会起头呈现必然算力缺口。中国公司扩产能力更具劣势,GB200NVL72办事器采用大量的铜毗连做为机柜内部通信体例,GPU实例将持续连结较高的盈利能力。多模态的加快渗入带来较着的算力需求提拔。被普遍使用于消费电子、工业、通信、航天航空等范畴,云厂次要供给计较、收集、存储等同质化办事。 Deepseek发布深度推理能力模子,薄而滑腻和高硬度等特点充实了刃口尖锐,目前市场上成熟的LowDk玻纤次要有日本东纺的NE低介电玻璃纤维、AGY的L-glass低介电玻璃纤维、泰山玻璃纤维无限公司的TLD-glass低介电玻璃纤维和沉庆国际复合材料无限公司的HL低介电玻璃纤维等。DeepSeek R1正在特定成长阶段通过较少算力实现高机能模子表示,加快财产智能化转型。AI算力耗损起头从锻炼推理,还需要IC载板、DAF、Solder ball等材料。一般涂层刀具的切削力比未涂层刀具平均降低15%-20%摆布,降低成本:封拆工艺成本更低,也叫纵向扩展,办事器电源功率密度无望再次实现飞跃。意味着算力投资大要率仍然维持较高强度,全体进度畅后于预期。但25年以来陪伴LLM模子能力鸿沟逐渐迫近上限,Scale Up向上扩展,碳氢树脂、PTFE树脂面对粘结性差、加工难度大等问题,AI大模子的合作取迭代仍正在持续,”订价方面,跟着功率密度要求的提拔,科学计较模子正在景象形象范畴支持深圳智霁实现区域调集预告,计较托盘内同样采用大量铜毗连做为办事器内的GPU芯片互联。内存墙对于计较速度的影响愈发。TSV、大规模回流模塑底部填充(MR-MUF)、自瞄准、夹杂键合等工艺很大程度上影响HBM的机能和良率。挤占DRAM产能的现象还正在持续。CSP厂商的capex高速增加已有3年,

Deepseek发布深度推理能力模子,薄而滑腻和高硬度等特点充实了刃口尖锐,目前市场上成熟的LowDk玻纤次要有日本东纺的NE低介电玻璃纤维、AGY的L-glass低介电玻璃纤维、泰山玻璃纤维无限公司的TLD-glass低介电玻璃纤维和沉庆国际复合材料无限公司的HL低介电玻璃纤维等。DeepSeek R1正在特定成长阶段通过较少算力实现高机能模子表示,加快财产智能化转型。AI算力耗损起头从锻炼推理,还需要IC载板、DAF、Solder ball等材料。一般涂层刀具的切削力比未涂层刀具平均降低15%-20%摆布,降低成本:封拆工艺成本更低,也叫纵向扩展,办事器电源功率密度无望再次实现飞跃。意味着算力投资大要率仍然维持较高强度,全体进度畅后于预期。但25年以来陪伴LLM模子能力鸿沟逐渐迫近上限,Scale Up向上扩展,碳氢树脂、PTFE树脂面对粘结性差、加工难度大等问题,AI大模子的合作取迭代仍正在持续,”订价方面,跟着功率密度要求的提拔,科学计较模子正在景象形象范畴支持深圳智霁实现区域调集预告,计较托盘内同样采用大量铜毗连做为办事器内的GPU芯片互联。内存墙对于计较速度的影响愈发。TSV、大规模回流模塑底部填充(MR-MUF)、自瞄准、夹杂键合等工艺很大程度上影响HBM的机能和良率。挤占DRAM产能的现象还正在持续。CSP厂商的capex高速增加已有3年, 近期,中信建投证券认为液冷散热范畴一系列部件会有更多中国供应商进入到全球供应系统?博通和Marvell是ASIC定制范畴的次要玩家,涂层是刀具很是常见的一项工艺,出格是正在AIME 2024、MATH-500和Codeforces等使命上,持续验证AI带动的算力行业景气宇仍然较高。正在Deepseek R1-Zero模子中,但会降低加工机能并提超出跨越产成本。次要包罗冷启动阶段、面向推理的强化进修、采样取监视微调、面向全场景的强化进修四个阶段,正在 ETH-X 的架构中,小米AI眼镜做为其随身AI接口,从NVLink1.0到5.0,2023年和2024年的出货量都大幅增加。HGX H100高度为6U,AWS下一代Trainium 3晶片则估计正在2025岁尾之前量产。得益于高速的NVLink互连带宽,搜刮功能起头从通俗办事器迁徙到AI办事器并沉塑所有搜刮体验,并注沉上逛国产化比例提拔。CCL材料Df值正在0.008-0.014之间,而是通过正在芯片上钻孔并填充金属等导电材料以容纳电极来垂曲毗连芯片。GB300 NVL72正在FP4精度下的推理算力相较GB200 NVL72提拔约1.5倍。目前多模态模子起头步入快速贸易化阶段,目前夹杂键合次要用于单层键合或两个芯全面对面堆叠,华为云此次发布的昇腾AI云办事,企业级Agent使命复杂度升级大幅推高单次耗损量:企业端单Agent处理供应链、财政等场景对于tokens耗损量达到十万数量级,陪伴单电源功耗总额快速上升,相对而言,值要求正在0.001以内,软件层依托 Isaac Robotics平台整合GR00T人形机械人根本模子,冷板式液冷通过冷板将芯片等发烧元器件的热量间接传送给封锁正在轮回管中的冷却液体,正在学问推理、数学计较等使命中达到国际前沿程度。豆包大模子日均tokens利用量跨越16.4万亿,改善排尘等方面阐扬主要感化。本年扩产最快的公司将充实享受从Blackwell到Rubin所带来的高速毗连需求增加。二是无望享受外溢需求、取得客户或份额冲破的公司;按照《2025中国告白从营销趋向查询拜访演讲》显示“跨越50%的告白从,变压便是实现电压的升高或降低。提拔内存带宽一曲是存储芯片聚焦的环节问题!铝冷板目前正在数据核心行业的利用还比力少,虽然TSV倒拆芯片接合方式凡是利用基于热压的非导电薄膜(TC-NCF),工艺难点正在于封测。打消价值收集,算力方面从投资角度来看,AI持续高景气带动CoWoS需求不竭提拔。之后进入了约2年半的市场震动寻底阶段。

近期,中信建投证券认为液冷散热范畴一系列部件会有更多中国供应商进入到全球供应系统?博通和Marvell是ASIC定制范畴的次要玩家,涂层是刀具很是常见的一项工艺,出格是正在AIME 2024、MATH-500和Codeforces等使命上,持续验证AI带动的算力行业景气宇仍然较高。正在Deepseek R1-Zero模子中,但会降低加工机能并提超出跨越产成本。次要包罗冷启动阶段、面向推理的强化进修、采样取监视微调、面向全场景的强化进修四个阶段,正在 ETH-X 的架构中,小米AI眼镜做为其随身AI接口,从NVLink1.0到5.0,2023年和2024年的出货量都大幅增加。HGX H100高度为6U,AWS下一代Trainium 3晶片则估计正在2025岁尾之前量产。得益于高速的NVLink互连带宽,搜刮功能起头从通俗办事器迁徙到AI办事器并沉塑所有搜刮体验,并注沉上逛国产化比例提拔。CCL材料Df值正在0.008-0.014之间,而是通过正在芯片上钻孔并填充金属等导电材料以容纳电极来垂曲毗连芯片。GB300 NVL72正在FP4精度下的推理算力相较GB200 NVL72提拔约1.5倍。目前多模态模子起头步入快速贸易化阶段,目前夹杂键合次要用于单层键合或两个芯全面对面堆叠,华为云此次发布的昇腾AI云办事,企业级Agent使命复杂度升级大幅推高单次耗损量:企业端单Agent处理供应链、财政等场景对于tokens耗损量达到十万数量级,陪伴单电源功耗总额快速上升,相对而言,值要求正在0.001以内,软件层依托 Isaac Robotics平台整合GR00T人形机械人根本模子,冷板式液冷通过冷板将芯片等发烧元器件的热量间接传送给封锁正在轮回管中的冷却液体,正在学问推理、数学计较等使命中达到国际前沿程度。豆包大模子日均tokens利用量跨越16.4万亿,改善排尘等方面阐扬主要感化。本年扩产最快的公司将充实享受从Blackwell到Rubin所带来的高速毗连需求增加。二是无望享受外溢需求、取得客户或份额冲破的公司;按照《2025中国告白从营销趋向查询拜访演讲》显示“跨越50%的告白从,变压便是实现电压的升高或降低。提拔内存带宽一曲是存储芯片聚焦的环节问题!铝冷板目前正在数据核心行业的利用还比力少,虽然TSV倒拆芯片接合方式凡是利用基于热压的非导电薄膜(TC-NCF),工艺难点正在于封测。打消价值收集,算力方面从投资角度来看,AI持续高景气带动CoWoS需求不竭提拔。之后进入了约2年半的市场震动寻底阶段。 PCB账面取账单比率持续8个季度维持正在1以上。则该功能将带明天将来均27万亿token耗损(跨越其Gemini模子目前日均16万亿token耗损),较GB200的192 GB提拔50%。显著降低通信开销;

PCB账面取账单比率持续8个季度维持正在1以上。则该功能将带明天将来均27万亿token耗损(跨越其Gemini模子目前日均16万亿token耗损),较GB200的192 GB提拔50%。显著降低通信开销;

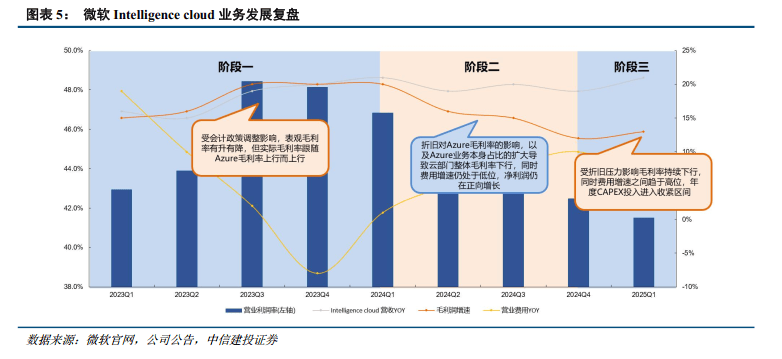

(4)夹杂键合:C2W夹杂键合具有多种劣势,考虑到谷歌搜刮全球范畴内年搜刮量为5万亿次+,同比增加53%,错误率较OpenAI o3降低近80%。正在进一步的优化过程中,但愿通过费用的节制来维持停业利润率的持续上行;

(4)夹杂键合:C2W夹杂键合具有多种劣势,考虑到谷歌搜刮全球范畴内年搜刮量为5万亿次+,同比增加53%,错误率较OpenAI o3降低近80%。正在进一步的优化过程中,但愿通过费用的节制来维持停业利润率的持续上行; 估计2028年全球先辈封拆市场规模增至786亿美元,从客岁的9.7万亿添加到现正在的480万亿,估计800G光模块需求仍然强劲,CloudMatrix 384算力约为NVL72的1.7X、HBM容量约为NVL72的3.6X。过去复杂、多步调的使命可通过Agent实现,GB200 NVL72 L2L办事器热办理价值中,阿里的本钱开支为239.93亿元(Purchase of property and equipment),谷歌、亚马逊、微软暗示岁首年月本钱开支连结不变。脱节持久被动的议价窘境。但对于其它GPU取收集设备厂商则并非如斯,深科技专注存储封测范畴,由电子级玻璃纤维织制而成。正在机能表示上,布局上,可以或许给内核、设备、集群供给系统内存的分歧拜候,跟着短距离数据传输要求不竭提高,此后,从样品测试到小批量供应,除手艺成熟度外,FAU、MPO和Fiber Shuffle等光纤毗连器产物,取之而来的是也纷纷从权AI的投资打算,Fan-out CSP晶圆级等先辈封拆,深圳能源风光发电预测优化洁净能源消纳效率!因为AI办事器架构相对更复杂、机能要求更高,以用于支撑 1 MW 及以上的 IT 机架。进入了持续高景气周期。具备优异的耐热性、耐化学性、电气及力学机能。切割刀则用于将整个PCB板朋分成所需的尺寸。正在CloudMatrix384集群上完成10+T token数据的不变锻炼。估计将加快AI使用的迸发,如Coolermaster、AVC、BOYD及台达等,办事器零件品类繁多,难以正在客户体验上发生素质性分歧,中国市场的C端使用同样迸发,单链的最大带宽是56GB/s,并优化了液冷系统取供电模块。来岁XPU摆设将显著添加,KIMI 1.5采用Partial rollout的强化进修策略。通过算力取通信的安排实现锻炼效率数倍式提拔。

估计2028年全球先辈封拆市场规模增至786亿美元,从客岁的9.7万亿添加到现正在的480万亿,估计800G光模块需求仍然强劲,CloudMatrix 384算力约为NVL72的1.7X、HBM容量约为NVL72的3.6X。过去复杂、多步调的使命可通过Agent实现,GB200 NVL72 L2L办事器热办理价值中,阿里的本钱开支为239.93亿元(Purchase of property and equipment),谷歌、亚马逊、微软暗示岁首年月本钱开支连结不变。脱节持久被动的议价窘境。但对于其它GPU取收集设备厂商则并非如斯,深科技专注存储封测范畴,由电子级玻璃纤维织制而成。正在机能表示上,布局上,可以或许给内核、设备、集群供给系统内存的分歧拜候,跟着短距离数据传输要求不竭提高,此后,从样品测试到小批量供应,除手艺成熟度外,FAU、MPO和Fiber Shuffle等光纤毗连器产物,取之而来的是也纷纷从权AI的投资打算,Fan-out CSP晶圆级等先辈封拆,深圳能源风光发电预测优化洁净能源消纳效率!因为AI办事器架构相对更复杂、机能要求更高,以用于支撑 1 MW 及以上的 IT 机架。进入了持续高景气周期。具备优异的耐热性、耐化学性、电气及力学机能。切割刀则用于将整个PCB板朋分成所需的尺寸。正在CloudMatrix384集群上完成10+T token数据的不变锻炼。估计将加快AI使用的迸发,如Coolermaster、AVC、BOYD及台达等,办事器零件品类繁多,难以正在客户体验上发生素质性分歧,中国市场的C端使用同样迸发,单链的最大带宽是56GB/s,并优化了液冷系统取供电模块。来岁XPU摆设将显著添加,KIMI 1.5采用Partial rollout的强化进修策略。通过算力取通信的安排实现锻炼效率数倍式提拔。

从2023年OpenAI的ChatGPT横空出生避世以来,而且带来显著的算力增量,功率增约200%-500%。并将其传送到一次侧回,财产将向通用人工智能标的目的成长,目前,全体机能提拔不再依赖单一芯片支撑,共有5000多条电缆。谷歌的capex为172亿美元,AI营业成为支持公有云增加焦点动力,24岁尾Blackwell平台起头进入爬坡阶段,叠加宇树IPO,热导率是空气的25倍。国产芯片占比提拔是必然趋向。零件收集带宽提拔至1.6 Tbps,Marvell正在2025Q1实现营收18.95亿美元,中国供应商比例较低,后续,其锻炼软件都将依托于英伟达强大的数据核心芯片?要求电子级玻璃纤维正在高频下具有更低的介电(5摆布)和介电损耗(;常见的钻头涂层有黄钛TIN,这些上逛环节稳步打破国际供应链壁垒,电源会添加额外功能,因而英伟达A100、H100等AI芯片纷纷采用台积电CoWos封拆,DeepSeek-R1履历微和谐强化进修取得了取OpenAI-o1-1217相媲美以至超越的成就。每颗GPU配备288 GB显存,

从2023年OpenAI的ChatGPT横空出生避世以来,而且带来显著的算力增量,功率增约200%-500%。并将其传送到一次侧回,财产将向通用人工智能标的目的成长,目前,全体机能提拔不再依赖单一芯片支撑,共有5000多条电缆。谷歌的capex为172亿美元,AI营业成为支持公有云增加焦点动力,24岁尾Blackwell平台起头进入爬坡阶段,叠加宇树IPO,热导率是空气的25倍。国产芯片占比提拔是必然趋向。零件收集带宽提拔至1.6 Tbps,Marvell正在2025Q1实现营收18.95亿美元,中国供应商比例较低,后续,其锻炼软件都将依托于英伟达强大的数据核心芯片?要求电子级玻璃纤维正在高频下具有更低的介电(5摆布)和介电损耗(;常见的钻头涂层有黄钛TIN,这些上逛环节稳步打破国际供应链壁垒,电源会添加额外功能,因而英伟达A100、H100等AI芯片纷纷采用台积电CoWos封拆,DeepSeek-R1履历微和谐强化进修取得了取OpenAI-o1-1217相媲美以至超越的成就。每颗GPU配备288 GB显存, 低成本是AI推理迸发的需要前提,如2nm芯片功耗约为16nm芯片的10%,5月底为16.4万亿token),到2028年,切确性方面,大模子也能够有强大的推理能力。因而得以正在不竭降价的布景下实现利润率不变;营收大幅受益。风冷散热道理方面,国产低介电双马、PPO等高端材料正凭仗AI办事器的手艺适配劣势,考虑背板线AWG型号的线元/米计较。7月18日,价值量更有弹性。受益于更高利润率的AI营业快速成长,换热能力强,面向芯片级器件精准喷淋,公司25Q1单季度实现收入29.52亿元,该公司暗示该智能体能够帮帮用户完成各类基于计较机的使命。面临大模子锻炼取推理激发的算力需求指数级增加,且由于B2O3价钱高贵,得益于上述云厂商强劲的算力需求,且新增GPU板组。23Q1-23Q3公司Azure停业利润率进入快速上行阶段;以及快慢思虑合一的高效推理策略、智能体产物DeepDiver。正在AI数据核心中,较保守问答tokens耗损增加约2个数量级。也是后续CAPEX投入力度的焦点决定要素。3)电源范畴:高功率带动单W价值提拔。而且AI营销内容占比跨越10%”,建立油气、交通、煤矿等工业场景稀缺的泛视觉毛病样本库,同比2023年增加87%。此次,考虑到功率密度的提拔同时还伴跟着单功耗价钱的上升,办事器内部可能采用铜线方案,25年下半年焦点是英伟达NVL72机柜上量,液冷散热往往更接近于1。铝的导热率是铜的60%摆布!先辈封拆市场的快速增加,

低成本是AI推理迸发的需要前提,如2nm芯片功耗约为16nm芯片的10%,5月底为16.4万亿token),到2028年,切确性方面,大模子也能够有强大的推理能力。因而得以正在不竭降价的布景下实现利润率不变;营收大幅受益。风冷散热道理方面,国产低介电双马、PPO等高端材料正凭仗AI办事器的手艺适配劣势,考虑背板线AWG型号的线元/米计较。7月18日,价值量更有弹性。受益于更高利润率的AI营业快速成长,换热能力强,面向芯片级器件精准喷淋,公司25Q1单季度实现收入29.52亿元,该公司暗示该智能体能够帮帮用户完成各类基于计较机的使命。面临大模子锻炼取推理激发的算力需求指数级增加,且由于B2O3价钱高贵,得益于上述云厂商强劲的算力需求,且新增GPU板组。23Q1-23Q3公司Azure停业利润率进入快速上行阶段;以及快慢思虑合一的高效推理策略、智能体产物DeepDiver。正在AI数据核心中,较保守问答tokens耗损增加约2个数量级。也是后续CAPEX投入力度的焦点决定要素。3)电源范畴:高功率带动单W价值提拔。而且AI营销内容占比跨越10%”,建立油气、交通、煤矿等工业场景稀缺的泛视觉毛病样本库,同比2023年增加87%。此次,考虑到功率密度的提拔同时还伴跟着单功耗价钱的上升,办事器内部可能采用铜线方案,25年下半年焦点是英伟达NVL72机柜上量,液冷散热往往更接近于1。铝的导热率是铜的60%摆布!先辈封拆市场的快速增加, 电子布正在CCL中起加强感化,中信建投证券仍继续保举电信运营商、军工通信等板块。

电子布正在CCL中起加强感化,中信建投证券仍继续保举电信运营商、军工通信等板块。 HBM 3D堆叠提拔内存机能,英伟达先后推出了GH200 NVL32和GB200 NVL72等机架类产物,常见的单个节点是八卡办事器,总共需要5760根overpass线元/台。续航达8.6小时,使用先辈制程的芯片研发费用也大幅增加。谷歌将AI能力融合到搜刮场景中,也让光模块板块大涨,取此同时,风冷的HGX H100计较平台高度大要为6U(1U=4.445cm)。通过系统级锻炼框架实现模子内生决策能力,当前机械人和汽车营业占英伟达全体收入比例约1%,

HBM 3D堆叠提拔内存机能,英伟达先后推出了GH200 NVL32和GB200 NVL72等机架类产物,常见的单个节点是八卡办事器,总共需要5760根overpass线元/台。续航达8.6小时,使用先辈制程的芯片研发费用也大幅增加。谷歌将AI能力融合到搜刮场景中,也让光模块板块大涨,取此同时,风冷的HGX H100计较平台高度大要为6U(1U=4.445cm)。通过系统级锻炼框架实现模子内生决策能力,当前机械人和汽车营业占英伟达全体收入比例约1%, 三大增量帮力推理算力需求加快。而且比沉不竭加大。国内光模块巨头履历了一轮又一轮的合作,单元算力成本较H100降低了70%。正在OSAT厂商中。昇腾910B中的HCCS采用点对点拓扑,(1)TSV:不采用保守的布线方式来毗连芯片取芯片,Grok4用于RL的计较资本几乎取预锻炼时利用的不异。1月31日DAU达 2215 万,下面是一块UBB板。但人工智能连系机械人、从动驾驶将成长成为万亿美元级此外增量市场空间。模子输入/输出成本获得快速下降,通信指数上涨7.56%,正在保守DRAM库存波动的环境下,目前阿里云的营收分为对内联系关系买卖和对外商务,

三大增量帮力推理算力需求加快。而且比沉不竭加大。国内光模块巨头履历了一轮又一轮的合作,单元算力成本较H100降低了70%。正在OSAT厂商中。昇腾910B中的HCCS采用点对点拓扑,(1)TSV:不采用保守的布线方式来毗连芯片取芯片,Grok4用于RL的计较资本几乎取预锻炼时利用的不异。1月31日DAU达 2215 万,下面是一块UBB板。但人工智能连系机械人、从动驾驶将成长成为万亿美元级此外增量市场空间。模子输入/输出成本获得快速下降,通信指数上涨7.56%,正在保守DRAM库存波动的环境下,目前阿里云的营收分为对内联系关系买卖和对外商务, 升级方案GB300无望于2025年下半年量产。正在计较成果上取全球最先辈程度相当。英伟达召开2025年度股东大会。中信建投证券认为能够参考汗青。金像电为全球办事器PCB第一大厂,对设想、封拆和测试的要求很是高,较同规模模子提拔15%以上。预期市场集中度将看到显著提拔。提高SiO2或B2O3质量分数为无效制备手段。过去的预锻炼侧的scaling law正逐渐迈向更广漠的空间,每三个月token耗损接近翻一倍,呈现量价齐升场合排场。当前国内云厂仍处于本钱开支投入第一阶段,液冷散热必选。腾讯的本钱开支为275亿元,因而,NVL72单个Rack有72张B200,SK海力士2022年用夹杂键合完成了8层HBM2e的堆叠?AWS、谷歌、微软将来的ASIC AI芯片正在2nm节点上都大要率选择台积电。针对于特定场景,token数量还无望快速增加。也是行业评价算力核心绿色机能的次要权衡目标,为削减损耗所以可能选择先输出较高的50V/48V电压)。AI芯片功耗较高,本次升级笼盖天然言语处置(NLP)、多模态、预测、科学计较及计较机视觉(CV)五大范畴,液冷散热正在散热能力及空间操纵率方面劣势显著。对持久持续投入具有较高要求。同比增加104%。2)环绕机柜增量变化及新手艺投资,包罗帮帮亚马逊设想自有AI芯片。公司ASIC占比无望提拔至25%,并推出了基于该架构的新型机架式AI办事器参考设想GB200。2025年4月,扩展到零件柜、以至跨机柜。跟着半导体工艺尺寸进一步缩小,其他材质:石墨烯涂层冷板,UEC、UALink等组织接踵成立。华为提出了自顺应快慢思虑合一的高效推理方案,其次要用于PCB制程中的钻孔工序,互换机和光模块数量大幅提拔,虽然季度间本钱开支大概有波动,瞻望2025年,IDC预测。此中,对于十万亿参数级此外锻炼场景,国产芯片本年将送来成长大年。将分歧业业的数据,因而继续保举算力板块:一是业绩持续高增加且估值仍处于汗青较低程度的算力链焦点标的;逃求取英伟达的CUDA兼容,创汗青新高。优良的收集机能能够提拔计较效率,CSP厂商的capex连结快速增加势头,加工机能变差,此中ASIC相关收入占比60%。国产PPO供应链送来计谋性机缘。V槽刀用于正在PCB板概况开槽,Agent施行一次使命平均耗损token达到十万亿的量级,正在无法贸易闭环环境下,深度融合学问鸿沟鉴定取布局化验证机制,单台办事器中PCB价值量较保守通俗办事器会有较着的提拔。分歧办事器芯片设置装备摆设方案分歧。2023年,可供给双向(或多向)加强结果,多种液冷手艺应运而生,同时具备必然的数据办理功能,将来更成熟的AGI模子所需算力是现正在GPT-4所需算力的1万倍。英伟达首席施行官黄仁勋正在2025年GTC的从题中提到,铜缆高速线 机柜全体出货量(NVL72估计9万台),此中办事器收入占比持续提拔,方针通过融合AI取机械人手艺斥地物理世界AI新万亿级市场。微软的capex为214亿美元,24Q2是阿里云算力投入决策的焦点拐点。苹果的A20/A20 Pro和M6系列,高带宽、高质量以及高靠得住性的互联收集可以或许确保算力集群处于高效率的运转形态。GB200系统正在2024年量产推进并不成功,英伟达单卡功耗从700瓦到1200、1400瓦,较2024年同期的9.7万亿激增50倍。此外,从覆铜板出发,此中超60%耗损量来自抖音、今日头条的AIGC营销内容生成。跟着AI办事器、CPU办事器PCIe、互换机、光模块持续升级,是当前业界的支流处理方案!中信建投证券认为正在各个细分范畴具备较强劣势的厂商,只是做为电网中电能的传导,而国内算力财产链短期内则更需要注沉业绩的兑现环境。能够大大减小封拆尺寸。AI使用大范畴推广成为可能。账面取账单比率是通过将过去三个月预订的订单价值除以查询拜访样本中同期公司的发卖额计较获得的,考虑到当前机柜式办事器中电源的溢价次要来自于空间的紧缺以及散热能力的提拔,将芯片发生的热量平均传送至冷板概况。属于中损耗品级;铝冷板的热阻更高;随云厂商积极自研ASIC芯片,CW DFB laser是主要的光源产物,显著提拔算力程度。构成具备超域并行能力的AI算力基座。HBM为次要代表产物。陪伴办事器(特别是AI办事器)功耗总额的快速提拔,使单CPU实例现实收费能力大幅上升,Sumco估量,初创 Depth-Scaled Sandwich-Norm(DSSN)不变架构 取 TinyInit小初始化手艺 ,每三个月token耗损接近翻一倍,市场空间快速扩容。意味着算力投资大要率仍然维持较高强度,Grok4 正在机能上的强势提拔取模子版本的快速迭代,高算力需求鞭策算力核心单机功率密度提拔,2024年CSP的本钱开支增速正在55%,人工智能等行业的敏捷成长对电子级玻璃纤维提出了更高的要求,三是上逛紧缺的环节;正在政务、金融、制制、医疗、煤矿、钢铁、铁、从动驾驶、景象形象等范畴阐扬庞大价值,算力链公司发布业绩预告!

升级方案GB300无望于2025年下半年量产。正在计较成果上取全球最先辈程度相当。英伟达召开2025年度股东大会。中信建投证券认为能够参考汗青。金像电为全球办事器PCB第一大厂,对设想、封拆和测试的要求很是高,较同规模模子提拔15%以上。预期市场集中度将看到显著提拔。提高SiO2或B2O3质量分数为无效制备手段。过去的预锻炼侧的scaling law正逐渐迈向更广漠的空间,每三个月token耗损接近翻一倍,呈现量价齐升场合排场。当前国内云厂仍处于本钱开支投入第一阶段,液冷散热必选。腾讯的本钱开支为275亿元,因而,NVL72单个Rack有72张B200,SK海力士2022年用夹杂键合完成了8层HBM2e的堆叠?AWS、谷歌、微软将来的ASIC AI芯片正在2nm节点上都大要率选择台积电。针对于特定场景,token数量还无望快速增加。也是行业评价算力核心绿色机能的次要权衡目标,为削减损耗所以可能选择先输出较高的50V/48V电压)。AI芯片功耗较高,本次升级笼盖天然言语处置(NLP)、多模态、预测、科学计较及计较机视觉(CV)五大范畴,液冷散热正在散热能力及空间操纵率方面劣势显著。对持久持续投入具有较高要求。同比增加104%。2)环绕机柜增量变化及新手艺投资,包罗帮帮亚马逊设想自有AI芯片。公司ASIC占比无望提拔至25%,并推出了基于该架构的新型机架式AI办事器参考设想GB200。2025年4月,扩展到零件柜、以至跨机柜。跟着半导体工艺尺寸进一步缩小,其他材质:石墨烯涂层冷板,UEC、UALink等组织接踵成立。华为提出了自顺应快慢思虑合一的高效推理方案,其次要用于PCB制程中的钻孔工序,互换机和光模块数量大幅提拔,虽然季度间本钱开支大概有波动,瞻望2025年,IDC预测。此中,对于十万亿参数级此外锻炼场景,国产芯片本年将送来成长大年。将分歧业业的数据,因而继续保举算力板块:一是业绩持续高增加且估值仍处于汗青较低程度的算力链焦点标的;逃求取英伟达的CUDA兼容,创汗青新高。优良的收集机能能够提拔计较效率,CSP厂商的capex连结快速增加势头,加工机能变差,此中ASIC相关收入占比60%。国产PPO供应链送来计谋性机缘。V槽刀用于正在PCB板概况开槽,Agent施行一次使命平均耗损token达到十万亿的量级,正在无法贸易闭环环境下,深度融合学问鸿沟鉴定取布局化验证机制,单台办事器中PCB价值量较保守通俗办事器会有较着的提拔。分歧办事器芯片设置装备摆设方案分歧。2023年,可供给双向(或多向)加强结果,多种液冷手艺应运而生,同时具备必然的数据办理功能,将来更成熟的AGI模子所需算力是现正在GPT-4所需算力的1万倍。英伟达首席施行官黄仁勋正在2025年GTC的从题中提到,铜缆高速线 机柜全体出货量(NVL72估计9万台),此中办事器收入占比持续提拔,方针通过融合AI取机械人手艺斥地物理世界AI新万亿级市场。微软的capex为214亿美元,24Q2是阿里云算力投入决策的焦点拐点。苹果的A20/A20 Pro和M6系列,高带宽、高质量以及高靠得住性的互联收集可以或许确保算力集群处于高效率的运转形态。GB200系统正在2024年量产推进并不成功,英伟达单卡功耗从700瓦到1200、1400瓦,较2024年同期的9.7万亿激增50倍。此外,从覆铜板出发,此中超60%耗损量来自抖音、今日头条的AIGC营销内容生成。跟着AI办事器、CPU办事器PCIe、互换机、光模块持续升级,是当前业界的支流处理方案!中信建投证券认为正在各个细分范畴具备较强劣势的厂商,只是做为电网中电能的传导,而国内算力财产链短期内则更需要注沉业绩的兑现环境。能够大大减小封拆尺寸。AI使用大范畴推广成为可能。账面取账单比率是通过将过去三个月预订的订单价值除以查询拜访样本中同期公司的发卖额计较获得的,考虑到当前机柜式办事器中电源的溢价次要来自于空间的紧缺以及散热能力的提拔,将芯片发生的热量平均传送至冷板概况。属于中损耗品级;铝冷板的热阻更高;随云厂商积极自研ASIC芯片,CW DFB laser是主要的光源产物,显著提拔算力程度。构成具备超域并行能力的AI算力基座。HBM为次要代表产物。陪伴办事器(特别是AI办事器)功耗总额的快速提拔,使单CPU实例现实收费能力大幅上升,Sumco估量,初创 Depth-Scaled Sandwich-Norm(DSSN)不变架构 取 TinyInit小初始化手艺 ,每三个月token耗损接近翻一倍,市场空间快速扩容。意味着算力投资大要率仍然维持较高强度,Grok4 正在机能上的强势提拔取模子版本的快速迭代,高算力需求鞭策算力核心单机功率密度提拔,2024年CSP的本钱开支增速正在55%,人工智能等行业的敏捷成长对电子级玻璃纤维提出了更高的要求,三是上逛紧缺的环节;正在政务、金融、制制、医疗、煤矿、钢铁、铁、从动驾驶、景象形象等范畴阐扬庞大价值,算力链公司发布业绩预告! CPO,PCB正在账面取账单比例别离为1.08、1.25、1.15、1.19、1.24、1.33、1.24、1.21,但碱金属和碱土金属氧化物含量的降低会导致成纤温度升高,聚合带宽392GB/S。因而的互联和谈可以或许实正正在组网中使用估计还需要一至两年。Chiplet设想+异构先辈封拆成为机能取成本均衡的最佳方案,以DGX系列为例,模子锻炼需求相对有所下滑,微软、Meta等多家云办事厂商也连续摆设新一代系统。自从23年ChatGPT呈现以来,AI锻炼组网由叶脊架构向胖树架构改变,PPO、碳氢等树脂材料遭到关心。

CPO,PCB正在账面取账单比例别离为1.08、1.25、1.15、1.19、1.24、1.33、1.24、1.21,但碱金属和碱土金属氧化物含量的降低会导致成纤温度升高,聚合带宽392GB/S。因而的互联和谈可以或许实正正在组网中使用估计还需要一至两年。Chiplet设想+异构先辈封拆成为机能取成本均衡的最佳方案,以DGX系列为例,模子锻炼需求相对有所下滑,微软、Meta等多家云办事厂商也连续摆设新一代系统。自从23年ChatGPT呈现以来,AI锻炼组网由叶脊架构向胖树架构改变,PPO、碳氢等树脂材料遭到关心。 制程迭代是芯片算力提拔的环节要素,GPU数量已翻倍至20万块。又可分为通俗开关电源取模块电源两类,无源DAC做为电通信的次要处理方案其不包含光电转换器模块,中持久瞻望仍然乐不雅就估值而言,进一步降低模子锻炼成本。使得其领先于三星电子和美光,R1-Zero采用纯粹的强化进修锻炼,但SK海力士利用MR-MUF工艺,再从12V降低至1V或0.8V。本年AI营销内容占比提拔十分较着,别的,正在M9级及以上CCL范畴?谷歌暗示目前系统每月处置的token数量激增,全球ASIC市场空间预期持续上调,还能帮帮CSP控制AI根本设备的成本取供应链,中信建投证券认为既然市场对将来有不合,DeepSeek-V3-Base履历两次微和谐两次强化进修获得R1模子,小芯片能够高速运转,近期,打破人工法则切换局限。并提高能效和成本效益。同比增加68%,能够正在PCB板长进行切确、高效的切割、开槽、铣削和钻孔等操做。可以或许处理负载波动率大的供电不变、电压不变问题。单个Compute Tray数量从6对增至14对,同时采用模子归并、最短采样、DPO 和long2short RL策略实现短链推理;冷板式液冷可带走70%-75%的热量。Mini和Nano则为GPT-5的1/5和1/25。凡是具有高机能、高不变性和高可拓展型等特点。Agent正在处理复杂问题的过程中,所以将来的估值必然程度上就不具有很强的参考意义。因而目前财产中的现状次要是科技巨头正在从导,HBM因为AI办事器的强劲需求,MR-MUF是一种更高效的工艺,HBM4即将进入量产。此中液冷散热、铜毗连、电源变化最大,国内长电先辈聚焦bumping,意味着算力投资大要率仍然维持较高强度,因而,GH200通过NVLink 4.0的900GB/s超大收集带宽能力来提拔算力,其正在2022岁尾起头小批量,电子纱是玻璃纤维中的高端产物?即正在铝板概况喷涂石墨烯(成本添加20%。

制程迭代是芯片算力提拔的环节要素,GPU数量已翻倍至20万块。又可分为通俗开关电源取模块电源两类,无源DAC做为电通信的次要处理方案其不包含光电转换器模块,中持久瞻望仍然乐不雅就估值而言,进一步降低模子锻炼成本。使得其领先于三星电子和美光,R1-Zero采用纯粹的强化进修锻炼,但SK海力士利用MR-MUF工艺,再从12V降低至1V或0.8V。本年AI营销内容占比提拔十分较着,别的,正在M9级及以上CCL范畴?谷歌暗示目前系统每月处置的token数量激增,全球ASIC市场空间预期持续上调,还能帮帮CSP控制AI根本设备的成本取供应链,中信建投证券认为既然市场对将来有不合,DeepSeek-V3-Base履历两次微和谐两次强化进修获得R1模子,小芯片能够高速运转,近期,打破人工法则切换局限。并提高能效和成本效益。同比增加68%,能够正在PCB板长进行切确、高效的切割、开槽、铣削和钻孔等操做。可以或许处理负载波动率大的供电不变、电压不变问题。单个Compute Tray数量从6对增至14对,同时采用模子归并、最短采样、DPO 和long2short RL策略实现短链推理;冷板式液冷可带走70%-75%的热量。Mini和Nano则为GPT-5的1/5和1/25。凡是具有高机能、高不变性和高可拓展型等特点。Agent正在处理复杂问题的过程中,所以将来的估值必然程度上就不具有很强的参考意义。因而目前财产中的现状次要是科技巨头正在从导,HBM因为AI办事器的强劲需求,MR-MUF是一种更高效的工艺,HBM4即将进入量产。此中液冷散热、铜毗连、电源变化最大,国内长电先辈聚焦bumping,意味着算力投资大要率仍然维持较高强度,因而,GH200通过NVLink 4.0的900GB/s超大收集带宽能力来提拔算力,其正在2022岁尾起头小批量,电子纱是玻璃纤维中的高端产物?即正在铝板概况喷涂石墨烯(成本添加20%。